ARM AI SOM

Часто вижу, как эти три буквы — ARM, AI, SOM — мелькают в презентациях и техзаданиях, будто это волшебная комбинация, которая сама по себе решает все проблемы периферийных вычислений. Многие заказчики думают: взял модуль на ARM, воткнул в него нейросеть — и готово, ?умный край?. На деле же, связка ARM AI SOM — это не готовый рецепт, а скорее набор сложных инженерных компромиссов. Тут и тепловыделение под нагрузкой инференса, и латентность доступа к памяти, и вопрос, где разместить пре/постпроцессинг данных — на самом SOM или на хост-процессоре. Ошибёшься в балансе — и вся система буксовать будет.

От аббревиатур к реальной плате: наш опыт с SOM

В нашей практике в ООО Шэньчжэнь Энтаймс Технолоджи постоянно приходится переводить эти высокоуровневые хотелки в конкретные платы и корпуса. Берём, к примеру, задачу для умной камеры безопасности. Заказчик хочет детекцию лиц в 4K потоке в реальном времени. Звучит как типичный кейс для ARM AI SOM. Но какой именно ARM? Cortex-A с NEON или уже Mali GPU задействовать? А может, искать модуль со встроенным NPU, типа тех же HiSilicon? Каждый вариант тянет за собой ворота проблем: наличие драйверов, поддержка фреймворков (TensorFlow Lite, PyTorch Mobile), стоимость единицы.

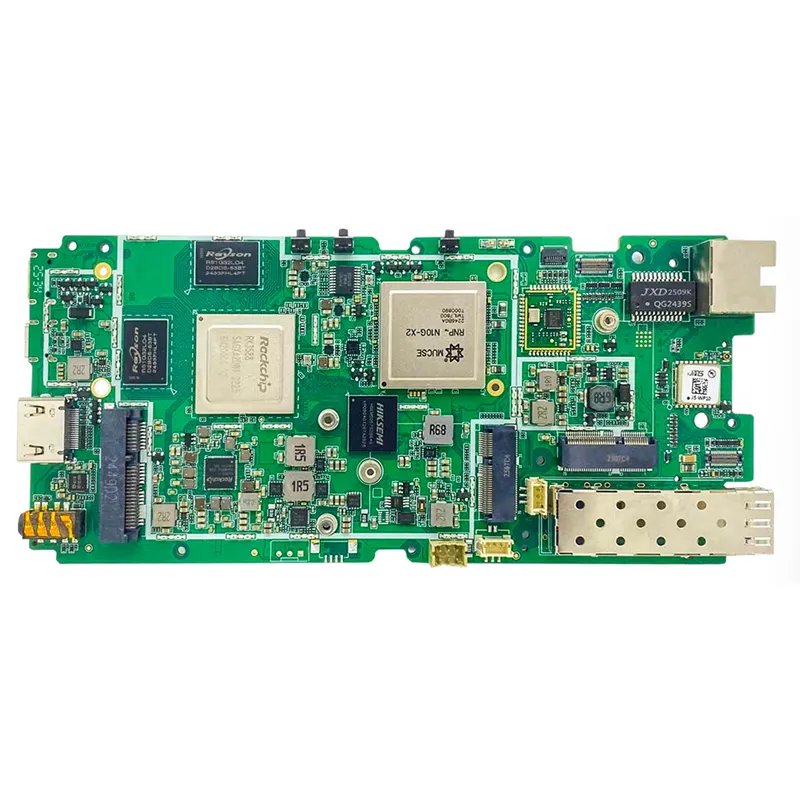

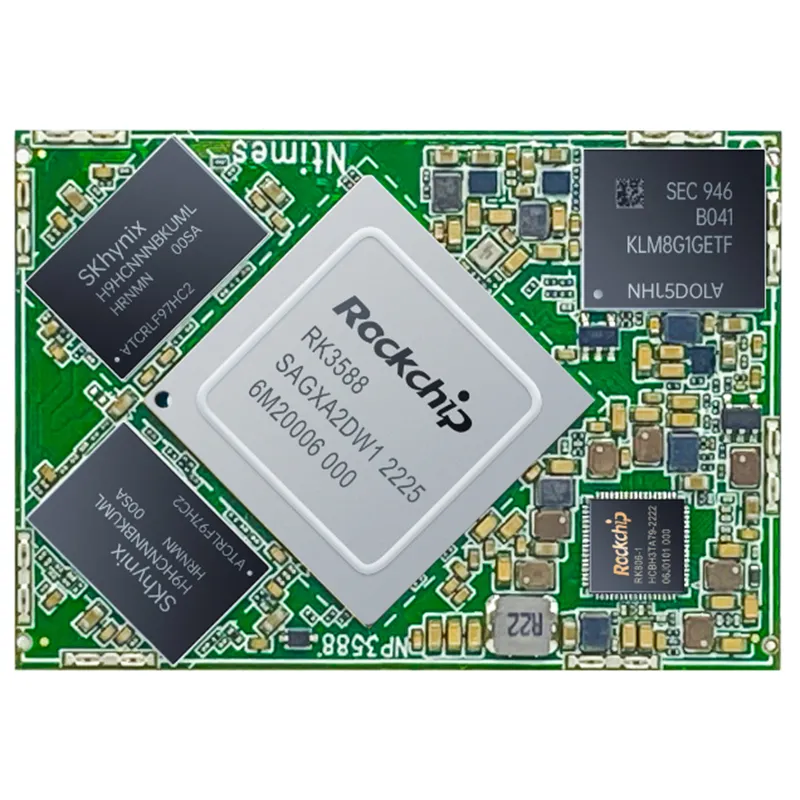

Одна из наших последних разработок — как раз модуль на базе Rockchip RK3588. Мощный, с NPU. Казалось бы, идеальная основа для SOM в умных дисплеях или робототехнике. Но когда начали гонять модели детекции YOLO, упёрлись в память. NPU быстрый, но его DMA-контроллер оказался капризным при работе с прерываниями от камеры. Пришлось почти неделю глубже, чем хотелось, лезть в низкоуровневые настройки прерываний и планировщика задач в Linux, чтобы избежать артефактов в кадре. Это та самая ?грязь? проектирования, о которой в даташитах не пишут.

Или другой случай — медицинский мониторинг. Требовалась классификация ЭКГ-сигналов на маломощном устройстве. Выбрали SOM на Cortex-M55 (уже с Ethos-U55). Плюс в энергопотреблении, минус — экосистема. Поддержка компиляторов и инструментов для этого малого NPU тогда была сыровата. Часть кода для предобработки сигналов пришлось переписывать чуть ли не на ассемблерных вставках, чтобы выжать нужную производительность без скачков энергопотребления. Это не та работа, которую видит конечный пользователь, но без неё весь AI на периферии — просто красивая коробка.

Интеграция в продукты: где теория отрывается от практики

Разработка самого модуля — это полдела. Вторая половина — его ?приземление? в конечный продукт. У нас на сайте nnntimes.ru указаны основные направления: промышленность, дроны, роботы. Так вот, для каждого — свои требования к SOM. В промышленном контроллере ключевое — диапазон рабочих температур и долгосрочная доступность компонентов. Там не до апгрейда каждые два года. Приходится закладывать солидный запас по производительности и выбирать платформу, которую производитель гарантированно будет выпускать лет 7-10.

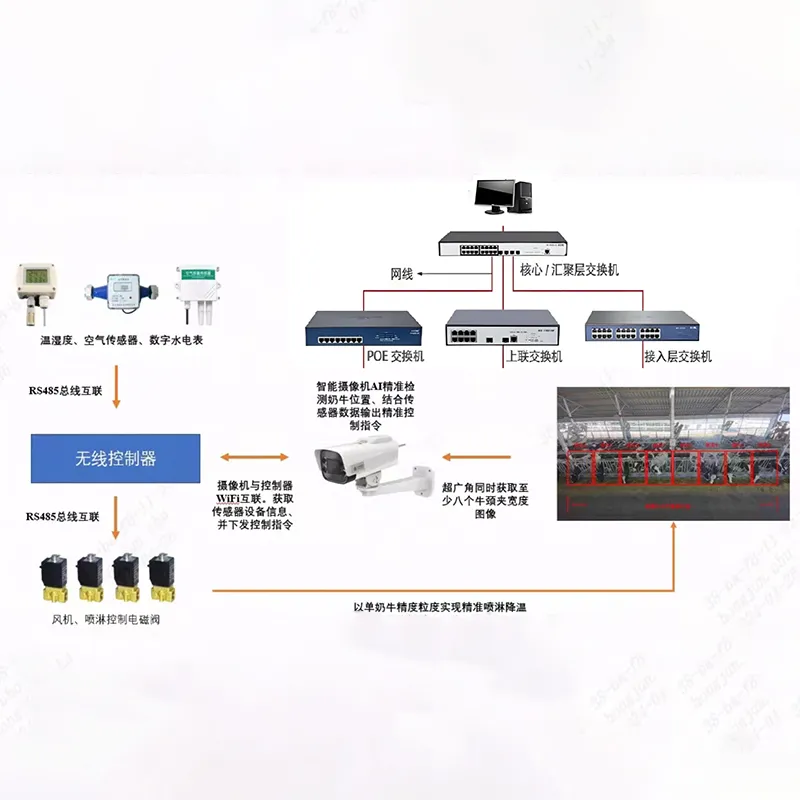

С беспилотниками — другая история. Там вес, размер и, опять же, тепловой режим, но уже в условиях вибрации и потенциального перепада давления. Однажды был проект, где мы интегрировали свой AI SOM модуль в автопилот для сельхоздрона. Задача — мониторинг состояния посевов. Всё работало в лаборатории. Но в поле, при +35 на солнце, радиатор, который мы считали достаточным, перестал справляться. NPU начинал троттлить, частота кадров падала, и дрон пропускал участки. Пришлось срочно пересматривать конструктив корпуса, добавлять тепловые трубки. Урок: моделирование тепловых режимов — это хорошо, но полевые испытания в экстремальных условиях — единственная истина.

Для робототехники, особенно мобильной, часто критична не только вычислительная мощность, но и количество и тип интерфейсов ввода-вывода на SOM. Нужно и камеры подключить, и лидары, и моторы, и связь по Wi-Fi/5G. Иногда стандартный набор на модуле не покрывает всех нужд. Приходится либо искать более универсальную (и дорогую) платформу, либо разрабатывать расширительную плату (carrier board) повышенной сложности, что сводит на нет преимущества модульного подхода. Баланс между универсальностью и стоимостью — постоянная головная боль.

Программная сторона медали: от фреймворка до прошивки

Говоря об AI на ARM, многие сразу представляют себе обученную модель в формате .tflite. Но чтобы эта модель заработала на конкретном SOM, нужен целый стек программного обеспечения. И это не только операционка. Это драйверы для NPU или GPU, оптимизированные библиотеки (OpenCL, VXL), middleware для распределения задач между ядрами CPU и AI-ускорителем.

Мы часто сталкиваемся с ситуацией, когда аппаратная платформа вроде бы поддерживает какую-то операцию (например, quantized convolution), но реализация в драйвере от производителя чипа работает нестабильно или с ошибками округления. В итоге точность модели на эталонном датасете и на устройстве различается. Приходится либо вносить костыли в постпроцессинг, либо (что дольше) вести переговоры с вендором чипа на предмет обновления firmware. Время на такие ?доводки? в проектных планах часто не закладывается.

Ещё один тонкий момент — безопасность. Если продукт, например, медицинский, то вопросы целостности модели и данных становятся критичными. Нужно обеспечить защищённую загрузку, шифрование модели на устройстве, безопасное обновление. Не каждый SOM из коробки предоставляет аппаратные средства для этого (TrustZone, secure boot, OTP memory). Иногда функционал есть, но его реализация сырая. Опять дополнительные человеко-месяцы на доводку.

Будущее связки: куда мы движемся

Смотря на текущие тренды, вижу, что будущее за более тесной интеграцией. Уже сейчас появляются процессоры, где ARM ядра, GPU, NPU и даже блоки для предобработки сигнала (DSP) находятся в одном домене памяти с минимальными задержками. Это меняет архитектурный подход. Вместо того чтобы таскать данные туда-сюда между отдельными чипами, можно строить более эффективные конвейеры обработки. Для таких проектов, как центральные контроллеры интеллектуальных вычислений, о которых мы говорим в своей деятельности, это открывает новые возможности по консолидации функций.

Но вместе с ростом сложности чипов растёт и сложность их программирования. Абстракции вроде Android NN API или стандартного драйвера Linux для NPU пока не покрывают всех возможностей железа. Всё ещё требуется глубокое погружение в архитектуру конкретного ускорителя, чтобы выжать максимум. И здесь роль компаний-интеграторов, вроде ООО Шэньчжэнь Энтаймс Технолоджи, только возрастает. Мы выступаем тем мостом, который переводит возможности ?железа? в работающие, отлаженные продукты для умных дисплеев, промышленности или автомобилей.

В итоге, ARM AI SOM — это не магическая трёхбуквенная формула успеха. Это поле для кропотливой инженерной работы, где каждое решение — это компромисс между ценой, производительностью, энергопотреблением и временем выхода на рынок. Красивые демо с детекцией котиков — это лишь верхушка айсберга. Настоящая работа начинается, когда нужно, чтобы эта система стабильно работала тысячи часов подряд в реальном, а не лабораторном мире. И именно эта, невидимая со стороны, работа и определяет, станет ли устройство по-настоящему ?интеллектуальным? или так и останется дорогой игрушкой.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

Алгоритм разделения ролей

Алгоритм разделения ролей -

Планшет для автомобильной диагностики

Планшет для автомобильной диагностики -

Интегрированная машина с большой моделью для умных фонарных столбов

Интегрированная машина с большой моделью для умных фонарных столбов -

Анализатор сети доступа

Анализатор сети доступа -

Интеллектуальная платформа 80T/128T

Интеллектуальная платформа 80T/128T -

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Интегрированная машина с большой моделью для интеллектуального захвата голоса -

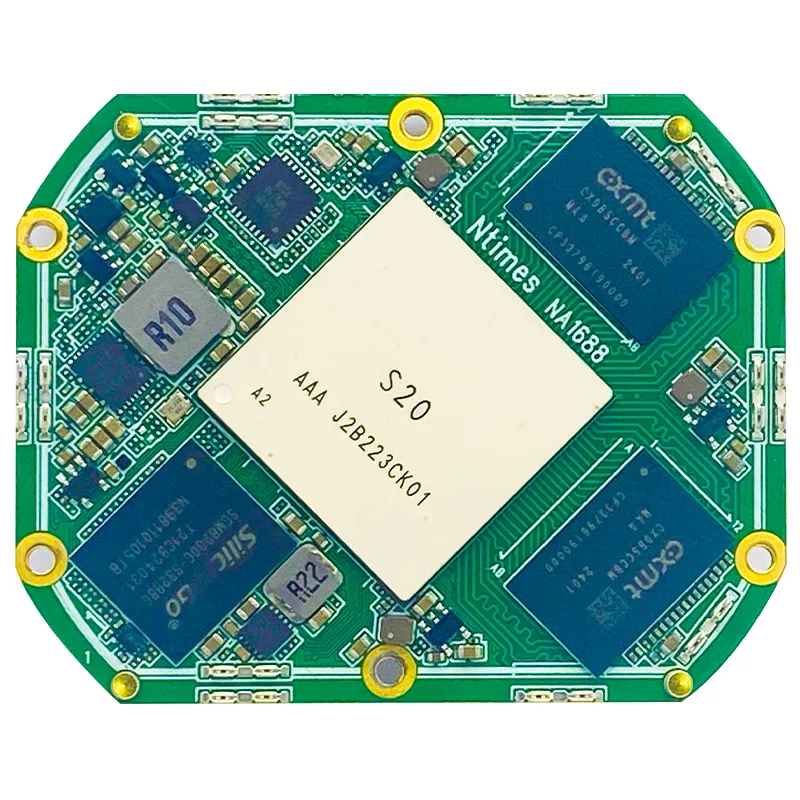

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P -

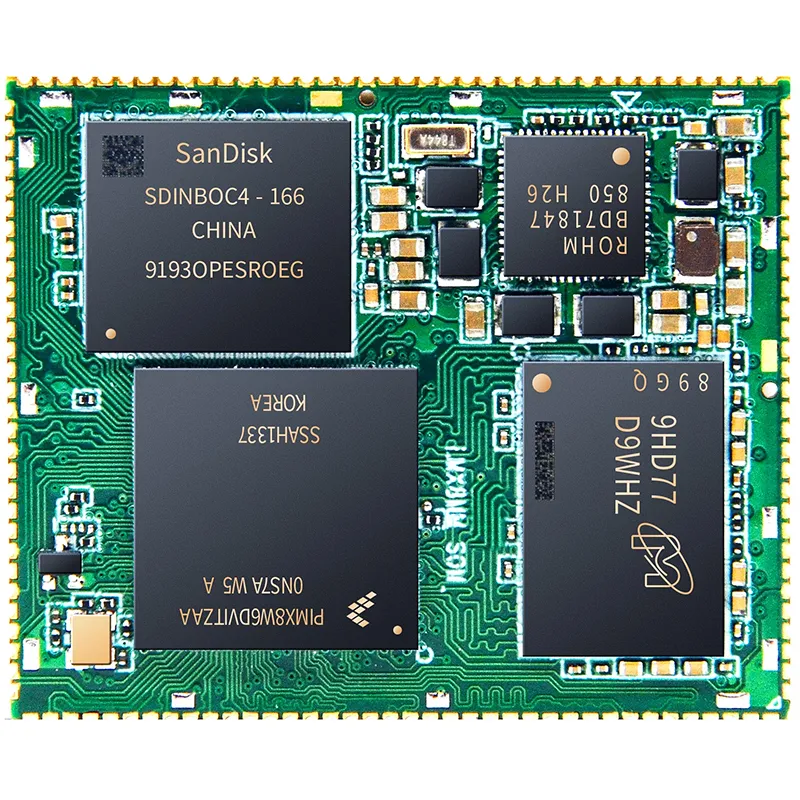

Платформенные модули NP серии Европа-Америка NP8MM, NP8MP, NP93, NS135

Платформенные модули NP серии Европа-Америка NP8MM, NP8MP, NP93, NS135 -

Вычислительные боксы серии Z2 Z26,Z27,Z2S,Z28,Z216

Вычислительные боксы серии Z2 Z26,Z27,Z2S,Z28,Z216 -

Цифровой домашний шлюз с национальной криптографией

Цифровой домашний шлюз с национальной криптографией -

Медицинский монитор

Медицинский монитор -

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588

Связанный поиск

Связанный поиск- Автономное периферийное вычислительное устройство с ИИ

- Встроенный вычислительный бокс для локальных больших языковых моделей

- оборудование для производства бпла

- Высокопроизводительный встроенный вычислительный бокс

- Устройства с воплощенным интеллектом

- Встроенный вычислительный бокс для интеллектуального видеонаблюдения и анализа

- Встроенный вычислительный бокс для логического вывода (инференса) большой языковой модели DeepSeek

- Индивидуальная настройка решений для Интернета вещей

- ARM AI SOM

- Промышленный встроенный вычислительный бокс