Встроенный вычислительный бокс для логического вывода (инференса) большой языковой модели DeepSeek

Когда говорят про встроенный вычислительный бокс для логического вывода большой языковой модели, многие сразу представляют себе серверную стойку или облачный API. Это, пожалуй, самый распространённый пробел в понимании. Суть как раз в обратном: задача — упаковать возможности модели типа DeepSeek в автономное, часто мобильное или стационарно-промышленное ?железо?, которое работает без постоянного облачного запроса. И вот здесь начинается самое интересное, а часто и самое сложное.

Где это вообще нужно? Контекст вместо хайпа

Не буду перечислять все сферы из презентаций. Из практики: самый живой интерес сейчас идёт не от IT-гигантов, а от индустрии, где есть чёткая задача, но нет возможности или желания ?сливать? данные наружу. Представьте диагностическое медицинское оборудование, которое должно в реальном времени анализировать протоколы исследований с помощью языковой модели, но по закону не может отправлять эти данные даже в защищённое облако. Или промышленный робот на конвейере, которому нужно по голосовой команде оператора скорректировать действие, а задержка в 2-3 секунды на обмен с сервером неприемлема. Вот здесь и встаёт вопрос о встроенном вычислительном боксе.

Мы в своё время плотно работали с командой ООО Шэньчжэнь Энтаймс Технолоджи (их сайт — nnntimes.ru). Их профиль — как раз развёртывание аппаратного обеспечения для периферийных вычислений, и они хорошо чувствуют эту потребность в ?закрытом контуре?. Их подход не в том, чтобы взять готовый чип и сказать ?вот, ставьте модель?, а в проектировании всей системы: от модулей интеллектуальных вычислений до конечного отраслевого продукта. Для них бокс для инференса DeepSeek — не универсальная игрушка, а платформа для конкретного сценария в робототехнике, БПЛА или медоборудовании.

Был у нас один проект с головными дисплеями для полевых техников. Задача — голосовой помощник по ремонту, работающий оффлайн. Пытались сначала использовать облегчённые открытые модели, но качество логического вывода для технических терминов хромало. Перешли к варианту с урезанной, но специально дообученной версией большой модели. И вот тут упёрлись в главное: даже ?урезанная? модель требует серьёзных ресурсов для инференса с приемлемой скоростью. Не просто мощный GPU, а сбалансированную систему: память, энергопотребление, теплоотвод. Это был первый звонок.

Аппаратная начинка: между необходимостью и компромиссом

Самый болезненный вопрос — выбор платформы. Можно взять мощный GPU от Nvidia для встраиваемых систем, но это сразу тянет за собой кучу всего: систему охлаждения, блок питания, стоимость. А продукт должен быть, в идеале, компактным и не слишком прожорливым. Пробовали варианты на базе некоторых чипов с NPU (нейропроцессорами). Да, они энергоэффективны, но их поддержка фреймворков для работы с такими большими моделями, как DeepSeek, часто сырая. Много времени ушло на низкоуровневую оптимизацию, порой приходилось писать свои плагины для трансформации модели.

Здесь опыт ООО Шэньчжэнь Энтаймс Технолоджи в создании центральных контроллеров интеллектуальных вычислений был кстати. Они не просто продают ?коробку?, а проектируют её под конкретный тепловой профиль и энергобюджет. В одном из наших совместных прототипов для беспилотника пришлось пожертвовать максимальным размером контекста модели, чтобы уложиться в лимит по тепловыделению. Жёсткий, но необходимый компромисс между интеллектуальными возможностями и физическими ограничениями носителя.

Ещё один нюанс — оперативная память. Параметры модели в несколько миллиардов — это десятки гигабайт весов. Для инференса их нужно загрузить в память. Значит, нужна быстрая DDR5 или HBM память в достаточном объёме. Это увеличивает стоимость и сложность платы. Мы рассматривали вариант с потоковой загрузкой весов с быстрого NVMe-накопителя, но это добавляет задержку. В итоге чаще идём по пути аппаратного апгрейда памяти, что делает вычислительный бокс не таким уж и миниатюрным. Идеала нет.

Программный стек и ?адъ? деплоя

С ?железом? более-менее разобрались — начинается следующий слой проблем: программный. Берёте вы модель DeepSeek в формате, скажем, PyTorch. Её нужно конвертировать в формат, который эффективно работает на вашей целевой аппаратуре (ONNX, TensorRT, OpenVINO и т.д.). Для больших моделей эта конвертация — нетривиальная задача. Могут ?сломаться? attention-механизмы, потеряться точность при квантовании. Мы потратили недели, пытаясь заставить модель после INT8-квантования адекватно отвечать на последовательные запросы, а не генерировать бессмыслицу после третьего вопроса.

Потом — рантайм. Нужна своя обвязка для загрузки модели, управления контекстом, обработки входных/выходных потоков. Плюс, часто требуется обеспечить работу нескольких экземпляров модели или очереди запросов, если бокс обслуживает несколько каналов (например, несколько камер с анализом видеопотока). Писали свои менеджеры памяти для GPU, чтобы избежать фрагментации при долгой работе. Без этого через сутки непрерывной работы инференс мог просто встать из-за нехватки памяти, хотя по факту она была.

И здесь снова вспоминается подход проектной компании. Они как раз смотрят на это не изолированно. Для них встроенный вычислительный бокс для логического вывода — это модуль, который должен быть интегрирован в более крупную систему: с собственным ПО устройства, датчиками, actuators. Поэтому их команда часто требует от нас не просто предоставить работающую модель на их железе, а дать чёткий API и документацию по ресурсам, чтобы это можно было вшить в контроллер робота или медицинского прибора. Это дисциплинирует и заставляет думать о продукте, а не о демо.

Кейсы и грабли: где теория расходится с практикой

Один из самых показательных проектов — это была интеграция в систему видеоаналитики для умного города. Задача: большая языковая модель использовалась не для генерации текста, а для семантического анализа транскрибированного аудио с городских камер (переговоры служб, обращения граждан) в связке с видео-объектами. Теоретически — мощно. Практически — latency. Модель справлялась, но время обработки одного пакета данных было на грани допустимого. Пришлось делать гибридную систему: простые сценарии обрабатывались классическими алгоритмами, а сложные, неоднозначные — отправлялись в LLM. Сам бокс работал в режиме микросервиса внутри общего контейнера.

Была и откровенно неудачная попытка — хотели сделать автономный гаджет для полевых журналистов с функцией быстрого конспектирования интервью и генерации тезисов на борту. Упирались в автономность. Даже с аккумулятором ёмкостью в 100 Вт*ч устройство работало в интенсивном режиме меньше двух часов. Пользователи сказали ?нет?. Выяснилось, что для такого сценария пока выгоднее использовать маленькую специализированную модель или вообще другие методы. Большая модель, даже эффективная, — слишком ?тяжёлая артиллерия? для этой задачи. Это был важный урок: не нужно применять LLM везде, где есть текст.

А вот в промышленности, наоборот, получилось интересно. Для контроля качества на производстве электроники добавили в систему визуального осмотра модуль, который по голосовым отчётам оператора и логам машины генерировал сводный отчёт на естественном языке. Встроенный бокс работал на линии, без выхода в интернет, и значительно сократил время на составление документации. Ключевым было то, что модель была дообучена на внутренней терминологии предприятия. Это к вопросу о важности не только ?железа?, но и данных для тонкой настройки.

Взгляд вперёд: что ещё предстоит решить

Сейчас основная боль — не столько в производительности, сколько в эффективности. Новые архитектуры моделей обещают лучшее качество при тех же параметрах или сопоставимое качество при меньшем размере. За этим нужно следить и быть готовым к миграции. Аппаратная часть вычислительного бокса должна иметь некоторый запас по производительности и памяти, чтобы через год можно было обновить модель, не меняя всё железо. Это сложно для планирования.

Второй момент — безопасность. Модель и её веса, хранящиеся на устройстве, — это интеллектуальная собственность и потенциальная уязвимость. Нужны механизмы защиты от извлечения, от несанкционированного доступа к ядру модели. Это область, которой ещё только предстоит развиться для встраиваемых систем с ИИ.

И наконец, инструментарий. Сейчас процесс деплоя такой модели на периферию — всё ещё удел инженеров высокого уровня. Нужны более простые и стандартизированные инструменты от вендоров железа и фреймворков. Чтобы инженер-разработчик медицинского прибора мог сосредоточиться на предметной области, а не на низкоуровневой оптимизации матричных умножений для конкретного NPU. Когда этот барьер снизится, встроенные вычислительные боксы для инференса больших моделей, будь то DeepSeek или другие, перестанут быть экзотикой и станут стандартным модулем в умных устройствах, как когда-то Wi-Fi-чип. А компании вроде ООО Шэньчжэнь Энтаймс Технолоджи, которые уже сейчас занимаются сквозным проектированием таких систем, окажутся в очень выгодной позиции. Они это, кажется, хорошо понимают.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

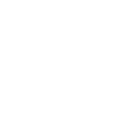

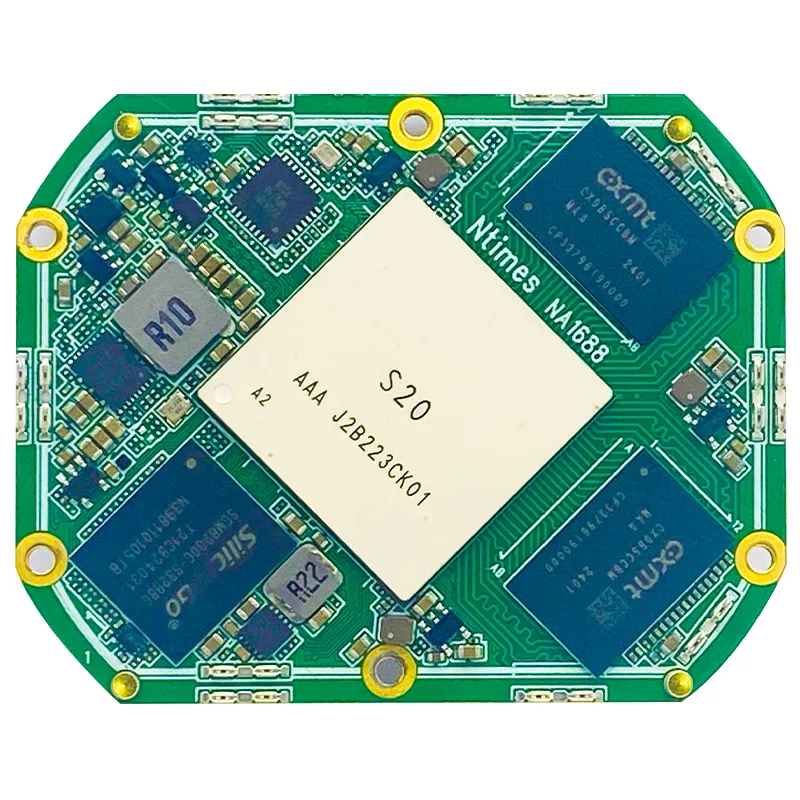

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P -

Интеллектуальная платформа 80T/128T

Интеллектуальная платформа 80T/128T -

Цифровой домашний шлюз с национальной криптографией

Цифровой домашний шлюз с национальной криптографией -

Пульт дистанционного управления для БПЛА

Пульт дистанционного управления для БПЛА -

Блок диагностики OBD для автомобилей

Блок диагностики OBD для автомобилей -

Наголовный 4K гигантский экран 3D плеер

Наголовный 4K гигантский экран 3D плеер -

Съемные модули серии NA NA1812CP, NA1684X

Съемные модули серии NA NA1812CP, NA1684X -

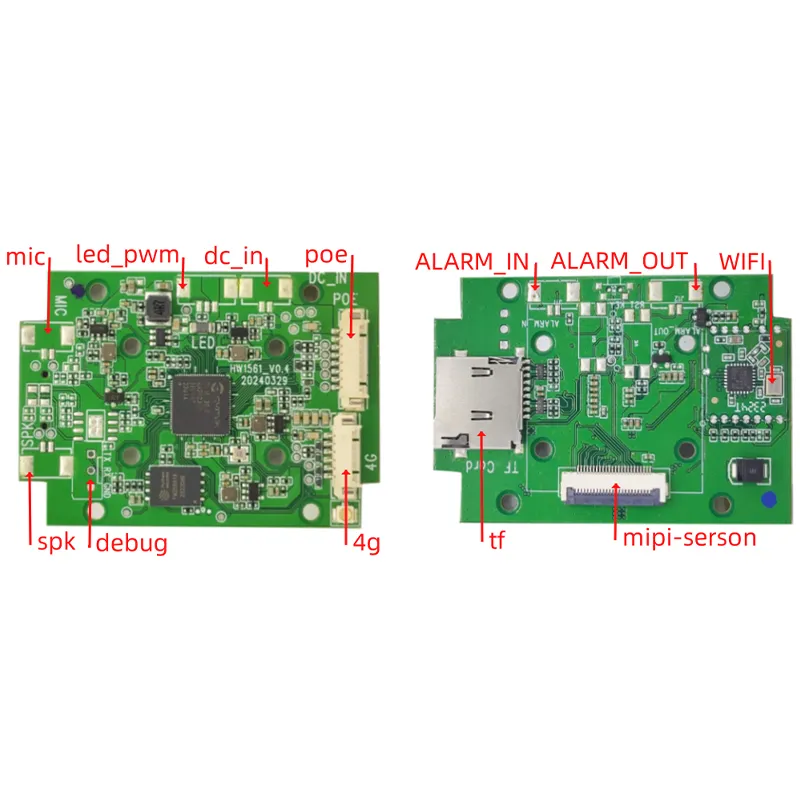

Локальная платформа видеонаблюдения и интернета вещей

Локальная платформа видеонаблюдения и интернета вещей -

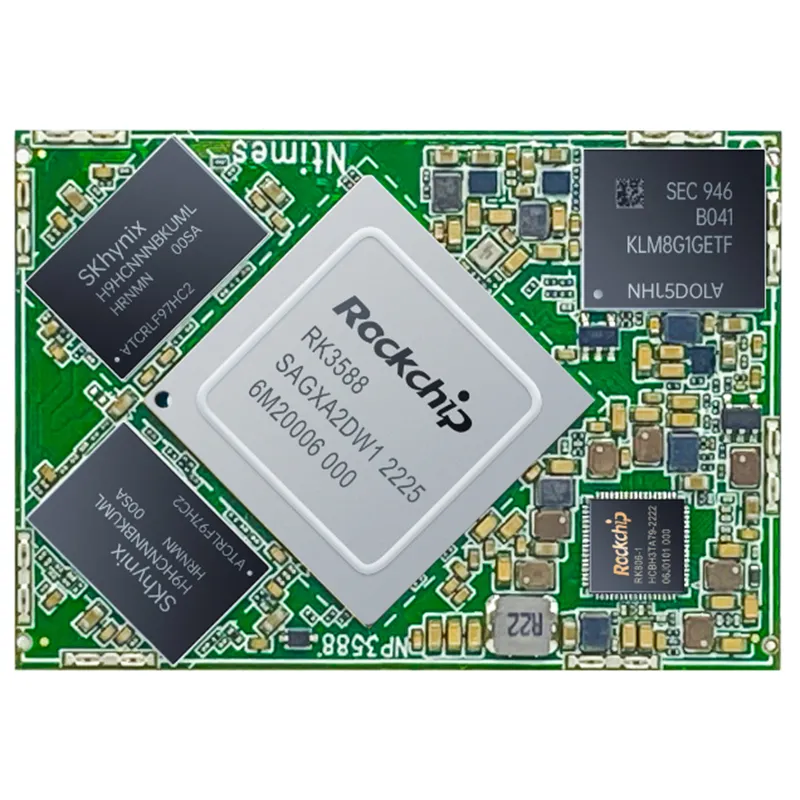

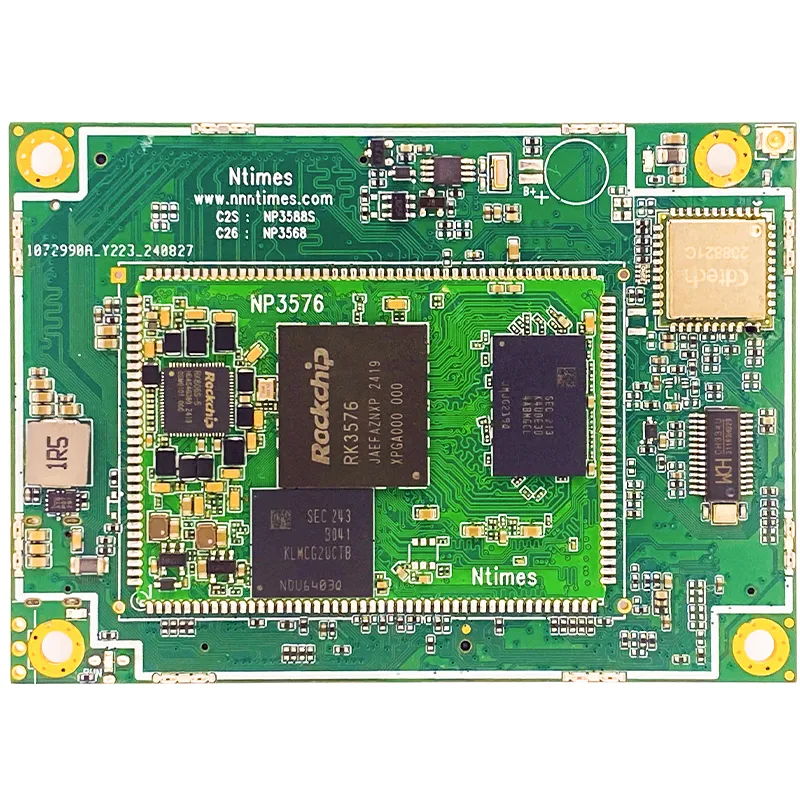

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588 -

Съемные модули серии C C26,C27,C2S,C28,C216,C6E,C6P

Съемные модули серии C C26,C27,C2S,C28,C216,C6E,C6P -

Микроскоп для биологических наук

Микроскоп для биологических наук -

Мобильный наголовный 3D дисплей

Мобильный наголовный 3D дисплей

Связанный поиск

Связанный поиск- Наголовный дисплей AR для промышленного контроля

- Модуль периферийных вычислений SOM

- Модуль подвеса (гондолы) для БПЛА

- Медицинский наголовный дисплей

- Встроенный вычислительный бокс для интеллектуального видеонаблюдения и анализа

- Материнская плата для роботов с воплощенным интеллектом

- Интеллектуальный агент с круговым обзором 360°

- Интеллектуальное устройство для угольных шахт

- VR головной дисплей

- som rk3568