Наголовный дисплей с низкой задержкой

Когда говорят про наголовный дисплей с низкой задержкой, многие сразу думают о VR-играх, где каждая миллисекунда на счету. Это верно, но лишь отчасти. На деле, низкая задержка — это вопрос не только комфорта, но и безопасности, и функциональности в целом ряде приложений, от промышленного обслуживания до медицинских симуляторов. Частая ошибка — гнаться за минимальной цифрой в данных, забывая, как эта задержка ощущается в реальной связке ?сенсор-процессор-дисплей? и при какой нагрузке она начинает ?плыть?. Собственно, об этом и хочу порассуждать, исходя из того, с чем приходилось сталкиваться на практике.

Что на самом деле скрывается за ?низкой задержкой??

В спецификациях часто красуется гордая надпись: ?задержка менее 20 мс?. Но это обычно latency motion-to-photon (MTP) в идеальных лабораторных условиях. На практике всё начинается с захвата движения. Гироскопы, акселерометры — их частота опроса, фильтрация шума. Потом данные идут на обработку. Вот здесь и кроется первый камень преткновения. Если вычислительный модуль не оптимизирован под такой поток данных в реальном времени, начинаются буферизации, микро-задержки. Получается, что даже с быстрым дисплеем, но слабым или неправильно сконфигурированным ?мозгом?, система будет тормозить.

Я помню один проект, где мы интегрировали сторонний трекинг. Цифры были прекрасны, но на деле алгоритм сглаживания траектории вносил дополнительную, неучтенную в спецификациях, задержку в 5-7 мс. Для аркадной игры — терпимо. Для симулятора, где нужно точно позиционировать инструмент, — катастрофа, вызывающая диссонанс и тошноту. Пришлось глубоко лезть в прошивку и совместно с инженерами поставщика переписывать часть кода фильтров, жертвуя немного ?плавностью? в угоду скорости отклика. Это был хороший урок: смотреть не на бумагу, а на поведение системы в целевой среде.

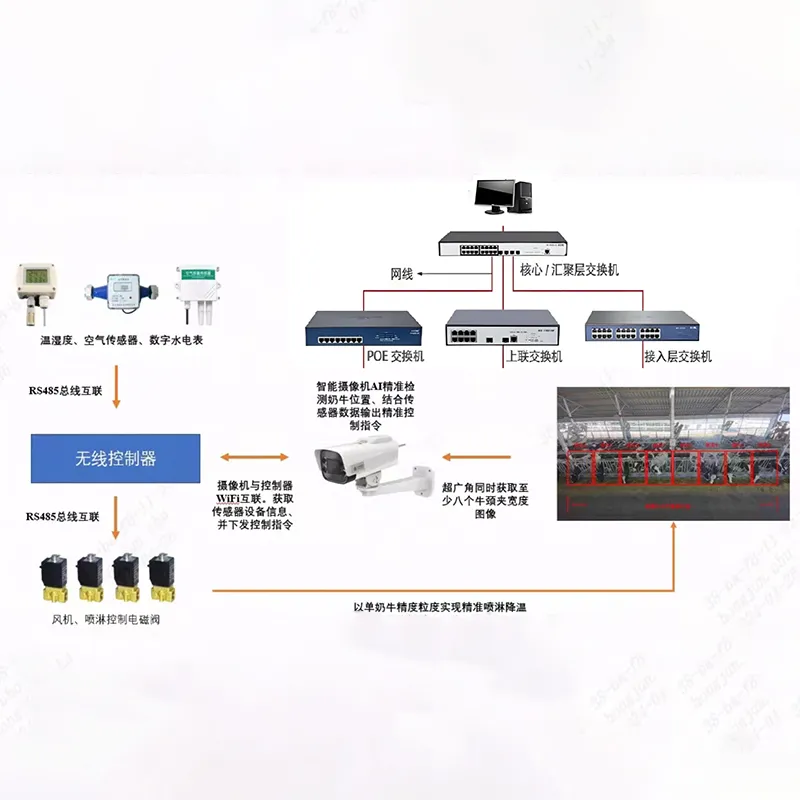

Именно поэтому в компаниях, которые занимаются железом для таких решений, как наголовный дисплей с низкой задержкой, фокус смещается на создание сбалансированных платформ. Например, взять ООО Шэньчжэнь Энтаймс Технолоджи. Они как раз проектируют аппаратное обеспечение для периферийных интеллектуальных вычислений, и их подход — это не просто поставка процессора, а создание модулей или целых контроллеров, где уже заложена оптимизация под потоковые задачи AI и компьютерного зрения. Это критически важно, потому что современный HMD — это не просто экранчик перед глазами, а комплекс из камер для inside-out трекинга, алгоритмов SLAM, возможно, отслеживания взгляда. Всё это должно вычисляться локально, с минимальной задержкой, и тут нужна специализированная вычислительная мощь, правильно распределенная.

Аппаратная часть: где ?узкие места? чаще всего?

Дисплей с частотой 90 или 120 Гц — это уже почти стандарт. Но сама по себе частота обновления не гарантирует низкой задержки. Важнее время отклика пикселя (pixel response time). Если оно велико, будут шлейфы, смазывание при быстром повороте головы. В некоторых промышленных HMD до сих пор используют LCD-панели с относительно высоким временем отклика, потому что они дешевле и имеют лучшую цветопередачу. Но для динамичных сцен это плохо. OLED лучше, но у них свои нюансы с персистенцией.

Следующее звено — интерфейс передачи данных. Здесь HDMI 2.1 или DisplayPort 1.4 — наши лучшие друзья. Но в беспроводных системах начинается ад. Wi-Fi 6E/7 и специальные протоколы вроде Wigig решают многое, но добавляют сложность в компрессию/декомпрессию видеопотока. Любая компрессия — это либо потеря качества, либо дополнительная задержка на кодирование/декодирование. В проектах, где важна абсолютная чистота картинки и минимальная задержка (например, в дистанционном управлении сложным оборудованием), часто от беспроводной связи отказываются в пользу проводного решения, как бы это ни было неудобно.

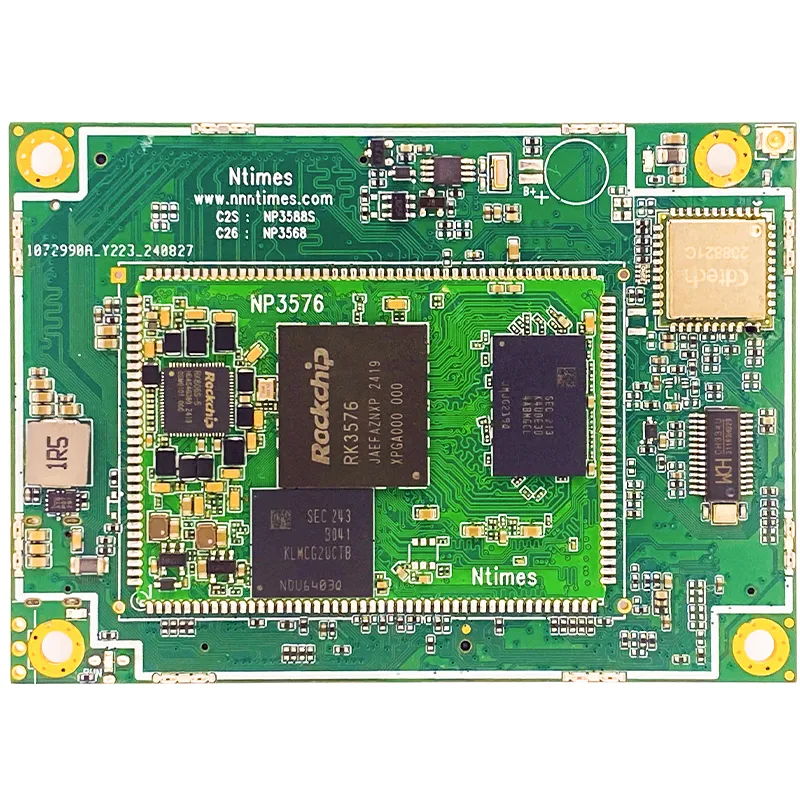

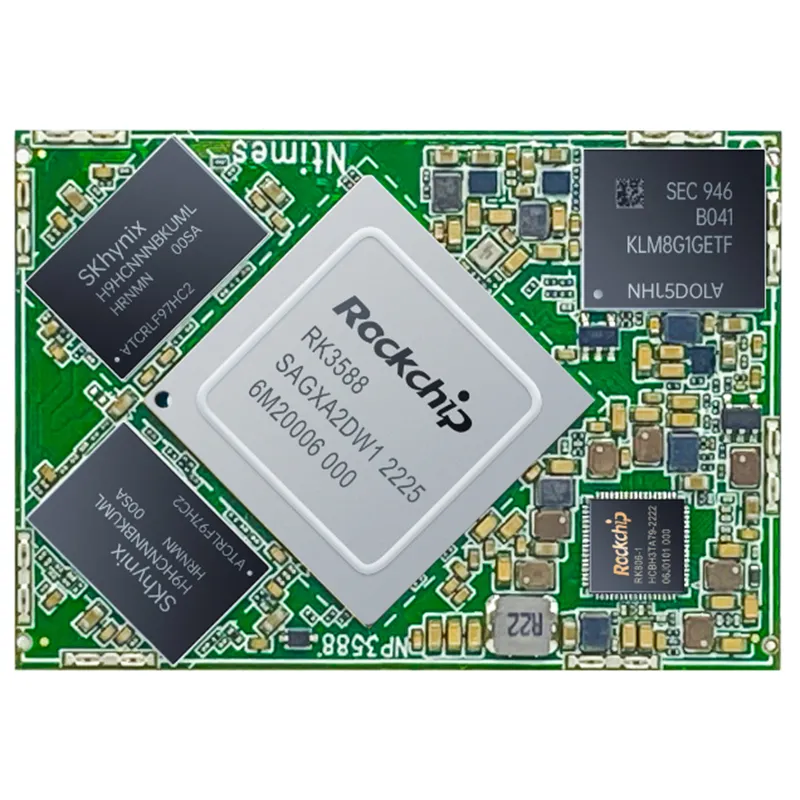

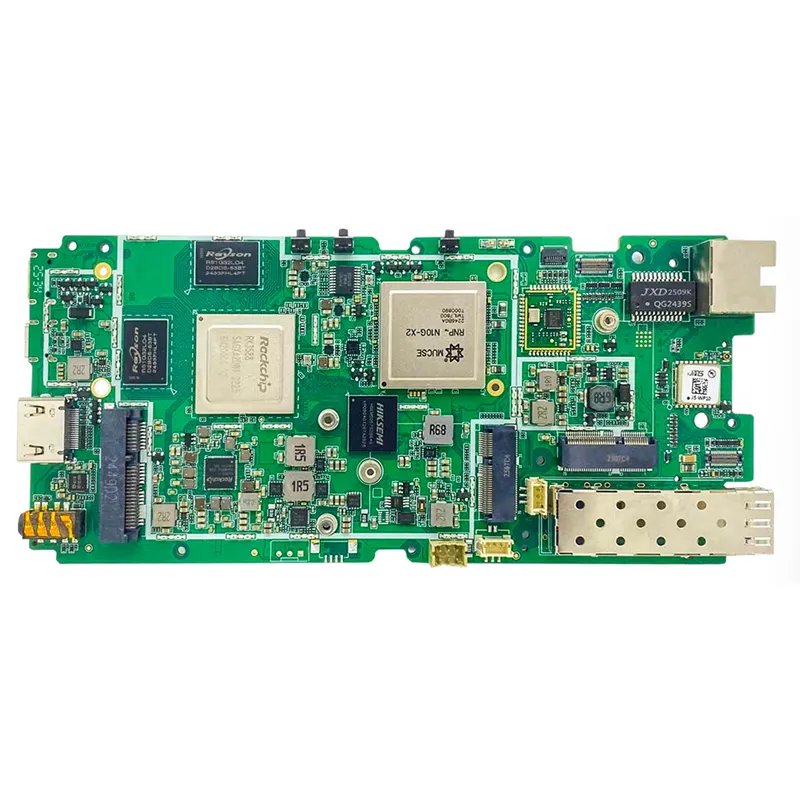

И, возвращаясь к ?мозгам?. Здесь тренд — использование специализированных SoC (System-on-Chip) или связок CPU+GPU+NPU (нейропроцессор). NPU берет на себя задачи инференса нейросетей — те же алгоритмы трекинга рук или распознавания объектов в окружении. Разгрузка центрального процессора позволяет снизить общую задержку системы. На сайте nnntimes.ru у ООО Шэньчжэнь Энтаймс Технолоджи как раз указано, что они проектируют модули интеллектуальных вычислений и центральные контроллеры. По сути, это и есть те самые ?мозги?, которые можно встроить в шлем, камеру или робота, чтобы вся обработка шла на edge, на периферии, без отправки данных в облако и обратно, что неизбежно вносит сотни миллисекунд задержки.

Практические кейсы: где низкая задержка — не прихоть, а необходимость

Промышленный ремонт и обучение. Был опыт внедрения AR-шлемов для техников, обслуживающих турбины. Человек в шлеме видел поверх реального оборудования наложенные схемы, подсказки по следующему шагу. Казалось бы, не самое динамичное применение. Но когда нужно совместить виртуальную метку с реальным болтом, а картинка ?плывет? с задержкой даже в 50 мс, это вызывает раздражение, неточность действий и в итоге — отказ от технологии. Мы тогда использовали платформу с акцентом на оптимизацию трекинга в помещении без маркеров, и ключевую роль сыграл именно вычислительный модуль, который быстро обрабатывал данные с камер и стабильно держал anchor points.

Медицинские симуляторы. Здесь вообще отдельная история. Симуляция эндоскопической операции, где движения инструментов должны точно и мгновенно отражаться в виртуальном пространстве. Задержка более 15-20 мс уже может сбивать моторные навыки хирурга. В таких системах часто используется гибридный подход: часть вычислений (рендеринг сложной анатомической модели) — на мощном внешнем ПК, а трекинг инструментов и головы — на локальном контроллере внутри симулятора. Задача — идеально синхронизировать эти два потока. Это та область, где продукты для периферийных интеллектуальных вычислений, как у упомянутой компании, находят прямое применение, выступая в роли того самого локального контроллера.

Автоспорт и авиация. Пилоты используют HMD для отображения тактической информации. Представьте, данные о скорости, курсе, цели обновляются с задержкой. В быстро меняющейся обстановке это недопустимо. Здесь системы проходят жесточайший отбор по надежности и скорости отклика. Часто они завязаны на специализированную шину данных самого транспортного средства, и задача HMD — просто быть сверхбыстрым конечным дисплеем. Но и тут своя сложность — обеспечить стабильность работы в условиях вибраций, перегрузок, электромагнитных помех.

Ошибки и тупиковые ветки: чему нас научили провалы

Была у нас попытка сделать бюджетный наголовный дисплей с низкой задержкой для рынка образовательной VR. Решили сэкономить на вычислительном блоке, взяв мобильный чипсет, не самый свежий. Логика была: для простых образовательных сцен хватит. Но забыли про ?навес? из софта — лаунчер, систему отслеживания, фоновые процессы. В итоге, даже простая сцена с вращением планет в реальном времени давала субъективно заметную задержку, потому что система была загружена ?по горло?. Вывод: нельзя оценивать производительность чипа в отрыве от целевой программной среды и фоновых задач. Лучше брать железо с запасом, особенно если планируется обновление софта.

Другой случай — чрезмерное увлечение беспроводностью. Интегрировали, как тогда казалось, передовой беспроводной адаптер. В лаборатории, в условиях радиочастотной ?чистоты?, всё работало отлично. Но на реальном объекте, в цеху с кучей Wi-Fi сетей и промышленным оборудованием, начались просадки пропускной способности и скачки задержки, что делало систему непригодной для использования. Пришлось срочно делать проводную модификацию. Теперь всегда закладываем сценарий работы в ?грязном? эфире и рассматриваем провод как основной вариант для критичных задач.

И еще один момент — калибровка. Можно собрать систему из лучших компонентов, но если плохо откалибровать взаимное положение датчиков IMU и камер, если неверно настроить prediction-алгоритмы (которые как раз предсказывают положение головы, чтобы компенсировать задержку рендеринга), то вся низкая задержка ?на железе? пойдет насмарку. Это кропотливая, невидимая со стороны работа, но именно она часто отделяет хороший продукт от посредственного.

Взгляд в будущее: куда движется технология

Сейчас очевидный тренд — это еще большая интеграция AI прямо в шлем. Не просто трекинг, а семантическое понимание окружения в реальном времени. Это потребует колоссальных вычислений, но и даст новый уровень интерактивности. Задержка здесь будет критична на новом уровне — задержка между действием пользователя и реакцией интеллектуального окружения. Соответственно, возрастет роль таких edge-вычислительных решений, которые компания ООО Шэньчжэнь Энтаймс Технолоджи обозначает как свою основную деятельность. Фактически, наголовный дисплей будущего — это будет мощный носимый компьютер с функциями интеллектуального восприятия, а не просто устройство отображения.

Другой вектор — улучшение самих дисплейных технологий. MicroLED сулят и высокую яркость, и контрастность, и фантастически низкое время отклика. Но пока это дорого и сложно в производстве для небольших панелей. Однако прогресс есть, и лет через пять это может стать новым стандартом для профессионального сегмента, где цена — не главный фактор.

И, наконец, стандартизация. Сейчас каждый производитель борется с задержкой своими методами. Было бы здорово увидеть более унифицированные подходы к измерению и сертификации реальной, а не теоретической, latency в различных сценариях нагрузки. Это помогло бы заказчикам, особенно корпоративным, делать более осознанный выбор, а не покупаться на красивые цифры в брошюре.

В итоге, создание по-настоящему эффективного наголовного дисплея с низкой задержкой — это всегда компромисс и системный подход. Нельзя вырвать один компонент и сделать на нем акцент. Это танец железа, софта, алгоритмов и, что немаловажно, глубокого понимания того, как конечный пользователь будет взаимодействовать с системой в реальных, а не идеальных условиях. И именно в этом танце рождаются решения, которые работают, а не просто продаются.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Интегрированная машина с большой моделью для интеллектуального захвата голоса -

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588 -

Анализатор сети доступа

Анализатор сети доступа -

Алгоритм разделения ролей

Алгоритм разделения ролей -

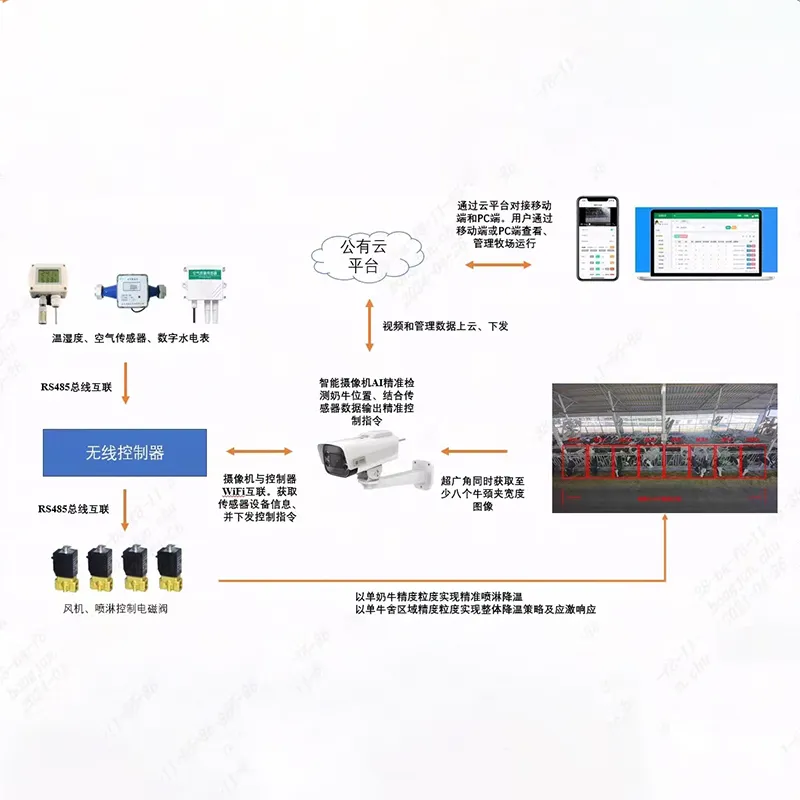

Платформа видеонаблюдения и интернета вещей на общедоступном облаке

Платформа видеонаблюдения и интернета вещей на общедоступном облаке -

Планшет для автомобильной диагностики

Планшет для автомобильной диагностики -

Блок диагностики OBD для автомобилей

Блок диагностики OBD для автомобилей -

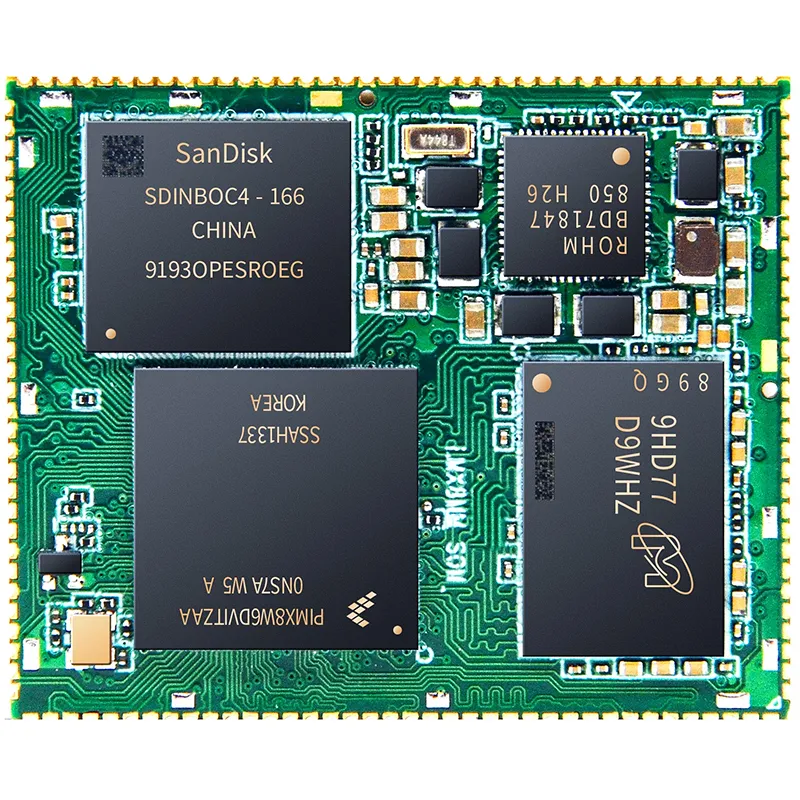

Платформенные модули NP серии Европа-Америка NP8MM, NP8MP, NP93, NS135

Платформенные модули NP серии Европа-Америка NP8MM, NP8MP, NP93, NS135 -

Пульт дистанционного управления для БПЛА

Пульт дистанционного управления для БПЛА -

Подвесная капсула для БПЛА

Подвесная капсула для БПЛА -

Интегрированная машина с большой моделью для умных фонарных столбов

Интегрированная машина с большой моделью для умных фонарных столбов -

Медицинский монитор

Медицинский монитор

Связанный поиск

Связанный поиск- Наголовный дисплей от первого лица (FPV) для БПЛА

- бпла подвес

- Периферийное (Edge) интегрированное устройство с мультимодальной LLM

- БПЛА для промышленного инспектирования и контроля

- оборудование для управления бпла

- Встроенный вычислительный бокс для логического вывода (инференса) большой языковой модели DeepSeek

- Контроллерная материнская плата для робособак

- Суперкомпьютерная материнская плата для роботов с вычислительной мощностью 128 терафлопс

- Наголовный дисплей смешанной реальности (MR)

- Кастомизация диагностического OBD-бокса