Периферийное (Edge) интегрированное устройство с мультимодальной LLM

Когда слышишь ?периферийное интегрированное устройство с мультимодальной LLM?, первая мысль — очередной маркетинговый конструкт, особенно на фоне всеобщего ажиотажа вокруг ИИ. Многие до сих пор путают это с простым запуском облачной модели на каком-нибудь одноплатнике, но суть-то в другом. Речь идёт о полноценном аппаратно-программном комплексе, где мультимодальность — не просто ?картинка + текст?, а согласованная обработка потоков данных с разных сенсоров в реальном времени, а LLM — ядро, принимающее решения на месте. Вот это ?на месте? и есть самое сложное.

Где теория расходится с практикой развёртывания

В теории всё гладко: берёшь мощный SoC, ставишь оптимизированную модель, подключаешь камеры и микрофоны — и устройство готово. На практике же, когда начинаешь собирать такое устройство для, скажем, автономного инспекционного робота, сразу упираешься в латентность. Мультимодальность требует синхронизации потоков: видео с тепловизора, данные лидара, возможно, аудиосигнал. Если обработка каждого модала идёт в отдельном конвейере, а потом результаты сливаются для LLM, возникают задержки, которые в промышленности часто неприемлемы. Мы в одном из ранних проектов для ООО Шэньчжэнь Энтаймс Технолоджи как раз на этом споткнулись, пытаясь использовать готовые модули.

Была задача сделать прототип для мониторинга оборудования — устройство должно было по визуальным данным и звуку вибрации определять аномалии. Взяли неплохой вычислительный модуль на базе NVIDIA Jetson, но столкнулись с тем, что фреймворк для мультимодального слияния данных съедал слишком много ресурсов на самой периферии. LLM, даже квантизированная, работала с приемлемой скоростью только на одном типе данных. Когда же пытались подать на вход согласованные видео и спектрограмму звука, инференс замедлялся в разы. Получался парадокс: устройство интегрированное, а мультимодальность не в реальном времени. Пришлось откатываться и пересматривать архитектуру.

Этот опыт показал ключевое: нельзя просто взять и ?интегрировать? разнородные компоненты. Нужно проектировать устройство изначально под конкретный мультимодальный пайплайн, где LLM не является надстройкой, а встроена в сам конвейер обработки сигналов. Именно этим, к слову, сейчас и занимается ООО Шэньчжэнь Энтаймс Технолоджи, сместив фокус с продажи модулей на проектирование законченных отраслевых продуктов, где железо и софт разрабатываются совместно под задачу.

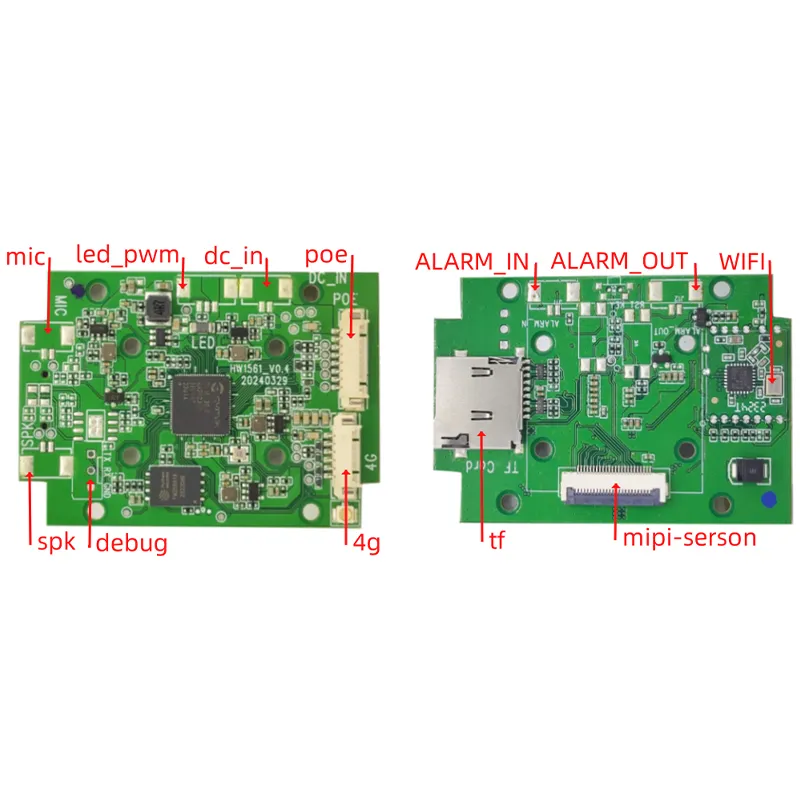

Аппаратная часть: выбор между универсальностью и эффективностью

С ?железом? для таких устройств всегда дилемма. Можно поставить максимально мощный и универсальный процессор, но тогда страдает энергопотребление, теплоотвод, да и стоимость. А можно заточить платформу под конкретные нейронные операции, которые будет выполнять мультимодальная LLM. Мы экспериментировали и с первым, и со вторым путём.

Для проекта в сфере медицинского оборудования (бесконтактный мониторинг состояния пациента) пробовали использовать платформу с CPU+GPU+NPU. Задача была сложная: анализ позы (видео), паттернов дыхания (радарный модуль) и возможных вербальных сигналов (аудио). NPU отлично справлялся с видео, но для аудио и радарных данных, которые после предобработки представляли собой временные ряды, эффективность падала. Универсальный GPU спасал, но ценой высокой энергоёмкости. В итоге пришли к гибридной архитектуре: лёгкая модель для быстрого анализа каждого потока в отдельном специализированном ядре (например, DSP для аудио), а уже сжатые, высокоуровневые фичи отправлялись в более общую, но оптимизированную LLM на CPU. Это снизило нагрузку и позволило уместиться в рамки портативного устройства.

Здесь как раз видна ценность опыта компании, которая занимается не просто сборкой, а проектированием. На их сайте nnntimes.ru указано, что они фокусируются на развёртывании аппаратного обеспечения вычислительной мощности в продукты периферийного интеллекта. На деле это означает, что они могут предложить не просто модуль, а консультацию по архитектуре: подсказать, где нужен специализированный AI-акселератор для обработки видео, а где хватит маломощного MCU для предфильтрации данных перед отправкой в основную LLM.

Программный стек и ?ад зависимостей?

Если с железом всё более-менее понятно, то софт — это настоящий ад. Особенно когда нужна мультимодальность. Одна модель для компьютерного зрения может требовать один набор библиотек и версий фреймворка, модель для NLP — другой, а механизм их слияния (early-fusion, late-fusion) — третий. Собрать это в единый образ, который будет стабильно работать на периферийном устройстве, — задача на грани искусства.

Помню, как мы потратили месяц, пытаясь заставить работать вместе TensorFlow Lite для декодера аудио и PyTorch Mobile для визуальной модели в рамках одного приложения на Android Things. Конфликты библиотек, разное управление памятью — кошмар. В итоге отказались от идеи использовать две разные экосистемы и перевели всё на единый фреймворк, пожертвовав немного точностью в одном из модалов. Это было болезненное, но необходимое решение для достижения стабильности.

Сейчас, глядя на подход ООО Шэньчжэнь Энтаймс Технолоджи к созданию центральных контроллеров интеллектуальных вычислений, понимаешь, что они идут по пути предоставления предварительно валидированного программного стека вместе с аппаратурой. Это огромный плюс для инженеров на местах. Вместо того чтобы самим проходить весь ад интеграции, они получают платформу, на которой уже можно относительно быстро собирать пайплайны, используя предоставленные API для работы с мультимодальными данными.

Реальные кейсы и уроки, которые не забываются

Всё, о чём говорю, проверялось в поле. Один из самых показательных кейсов — разработка устройства для умной безопасности на периметре объектов. Задача: не просто детектировать движение, а классифицировать событие (человек, животное, транспорт) и оценить намерения на основе поведения, используя видео и, возможно, аудио с распределённых датчиков. Тут без мультимодальной LLM на edge не обойтись, потому что отправлять все видеопотоки в облако — дорого и медленно.

Первая версия устройства выдавала много ложных срабатываний на тени от деревьев или крупных птиц. Мы добавили анализ аудиопотока (шаги, звук двигателя) в качестве второго модала для подтверждения события. Но простое логическое ?И? между результатами двух моделей не работало — часто звук запаздывал или его не было. Тогда мы обучили небольшую LLM (по сути, трансформер) принимать совместное решение на основе временных эмбэддингов от визуальной и аудиомоделей за короткое окно времени. Это резко снизило количество ложных тревог. Устройство стало умнее, но потребовало более тонкой настройки и калибровки сенсоров на месте.

Этот проект подтвердил мысль, что истинная ценность периферийного интегрированного устройства раскрывается, когда оно решает комплексную задачу, недоступную для мономодальных систем. И именно в таких нишах, как безопасность, промышленность, медицинское оборудование, которые указаны в описании деятельности ООО Шэньчжэнь Энтаймс Технолоджи, и кроется основной рынок.

Будущее: специализация и конвергенция

Куда это всё движется? На мой взгляд, мы увидим не универсальные edge-устройства ?для всего?, а всё большую специализацию. Будут появляться устройства, заточенные именно под мультимодальный анализ в робототехнике (видео+лидар+тактильные датчики), или под диагностику в медицине (визуализация+звук+данные датчиков). LLM в них будет не общей, вроде GPT, а узкоспециализированной, возможно, даже обученной с нуля на доменных данных.

Вторая тенденция — конвергенция вычислительных модулей. Вместо отдельных блоков для зрения, аудио и NLP будут создаваться гетерогенные чипы, способные эффективно выполнять операции, характерные для трансформеров — основы современных LLM, независимо от типа входных данных. Это позволит создавать более компактные и энергоэффективные периферийные интегрированные устройства.

Компании, которые, подобно ООО Шэньчжэнь Энтаймс Технолоджи, уже сейчас глубоко погружены в проектирование отраслевых продуктов интеллектуальных вычислений, находятся в выигрышной позиции. Они понимают не только технологии, но и реальные потребности индустрий — от беспилотных летательных аппаратов до медицинского оборудования. Их опыт в создании законченных решений, а не просто ?кирпичей? в виде модулей, будет критически важен для превращения модного термина ?периферийное интегрированное устройство с мультимодальной LLM? в массовую и полезную реальность.

В итоге, всё сводится к простой, но трудной истине: магия происходит не на слайдах презентаций, а в гараже, на испытательном полигоне или в цеху, где инженеры часами отлаживают синхронизацию сенсоров, чтобы мультимодальная LLM на краю сети наконец-то увидела мир целостно и приняла правильное решение. И это того стоит.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

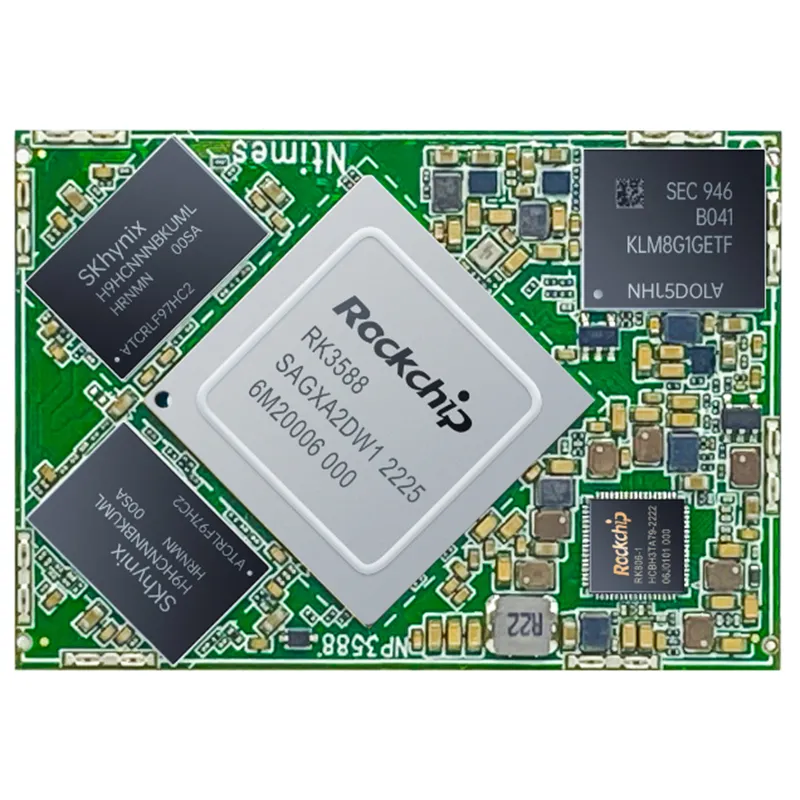

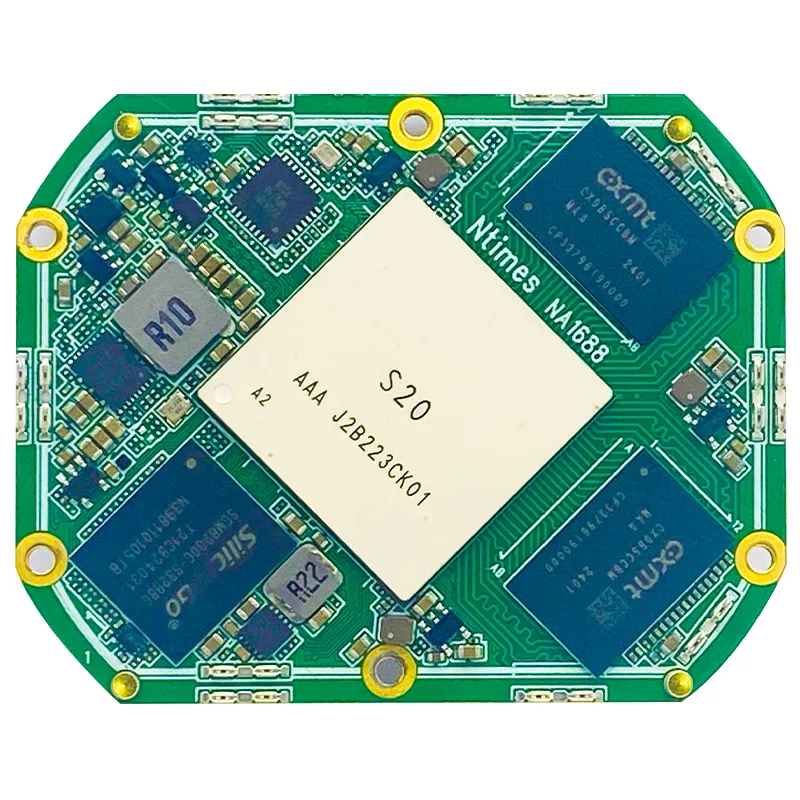

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P -

Пульт дистанционного управления для БПЛА

Пульт дистанционного управления для БПЛА -

Алгоритм разделения ролей

Алгоритм разделения ролей -

Наземная станция для БПЛА AheadX

Наземная станция для БПЛА AheadX -

Подвесная капсула для БПЛА

Подвесная капсула для БПЛА -

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Интегрированная машина с большой моделью для интеллектуального захвата голоса -

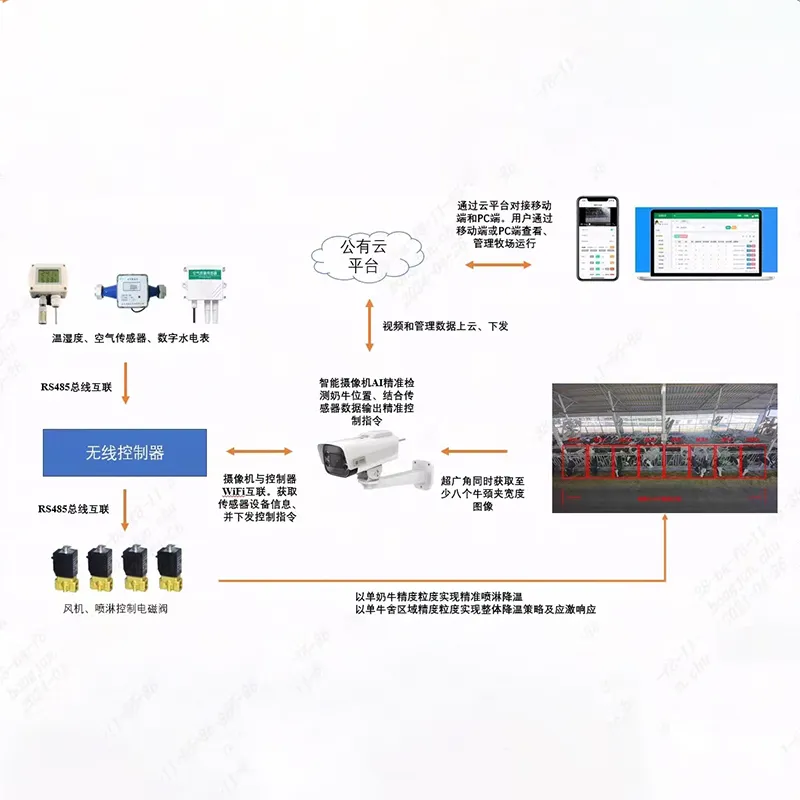

Платформа видеонаблюдения и интернета вещей на общедоступном облаке

Платформа видеонаблюдения и интернета вещей на общедоступном облаке -

Цифровой домашний шлюз с национальной криптографией

Цифровой домашний шлюз с национальной криптографией -

Программный каркас

Программный каркас -

Вычислительные боксы серии Z9 Z96,Z98,Z97,Z9S

Вычислительные боксы серии Z9 Z96,Z98,Z97,Z9S -

Съемные модули серии NA NA1812CP, NA1684X

Съемные модули серии NA NA1812CP, NA1684X -

Мобильный наголовный 3D дисплей

Мобильный наголовный 3D дисплей

Связанный поиск

Связанный поиск- Индивидуальная настройка вычислительной системы для роботов с воплощенным интеллектом

- Компактный встроенный вычислительный бокс

- Модуль периферийных вычислений SOM

- Бокс вычислений для логистики

- Подвес БПЛА с 30-кратным оптическим зумом

- Кастомизация центрального управления БПЛА

- Кастомизация медицинского монитора пациента

- Встраиваемая материнская плата для роботов

- Суперкомпьютерная материнская плата для роботов с вычислительной мощностью 128 терафлопс

- OLED-гарнитура с дисплеем