Продукция

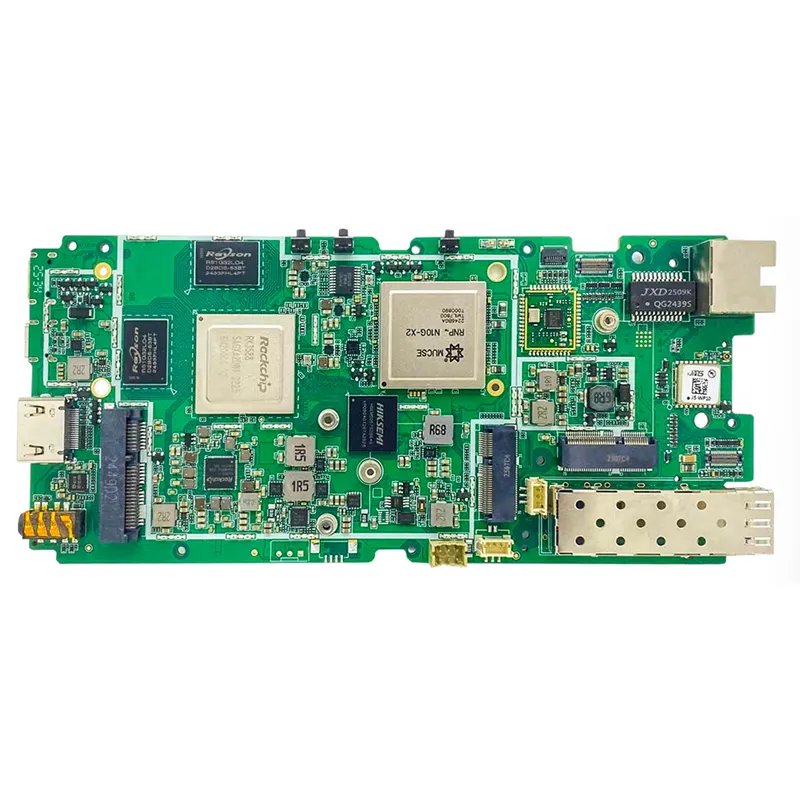

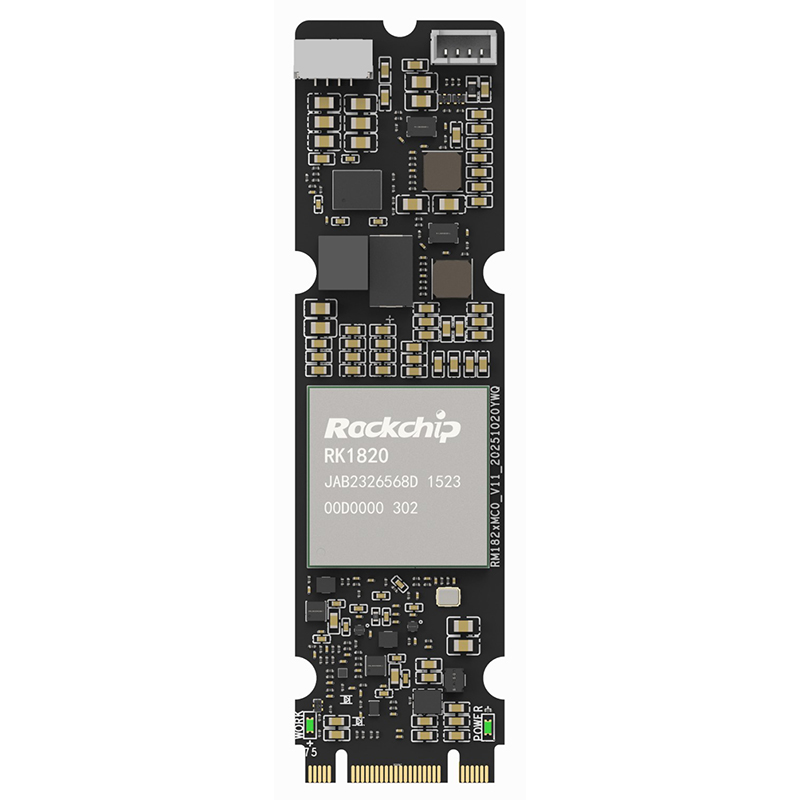

Rockchip RK1820 RK1828 Вычислительная мощность NPU: 20 Т

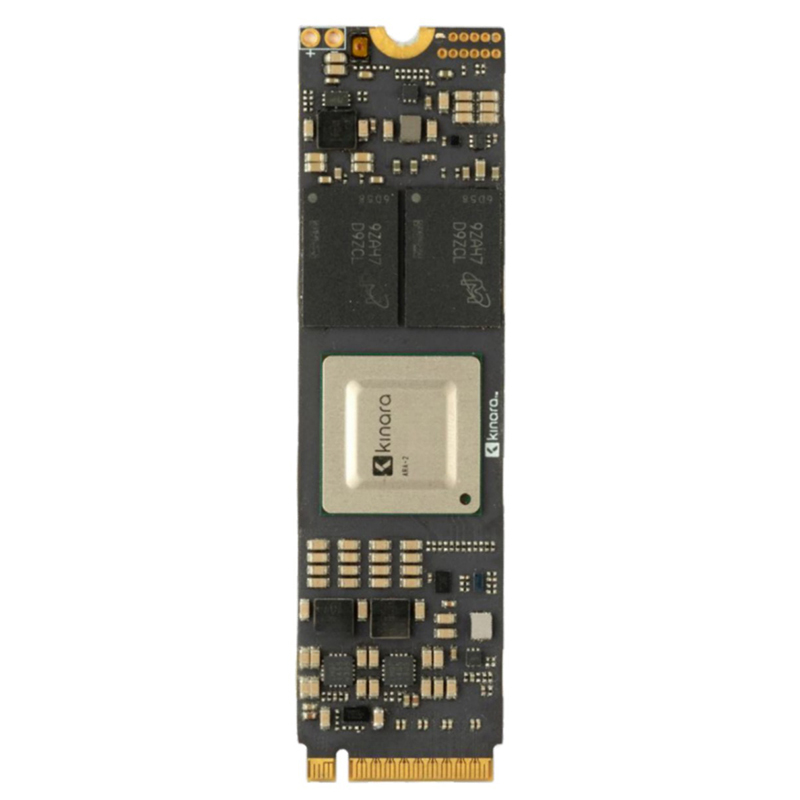

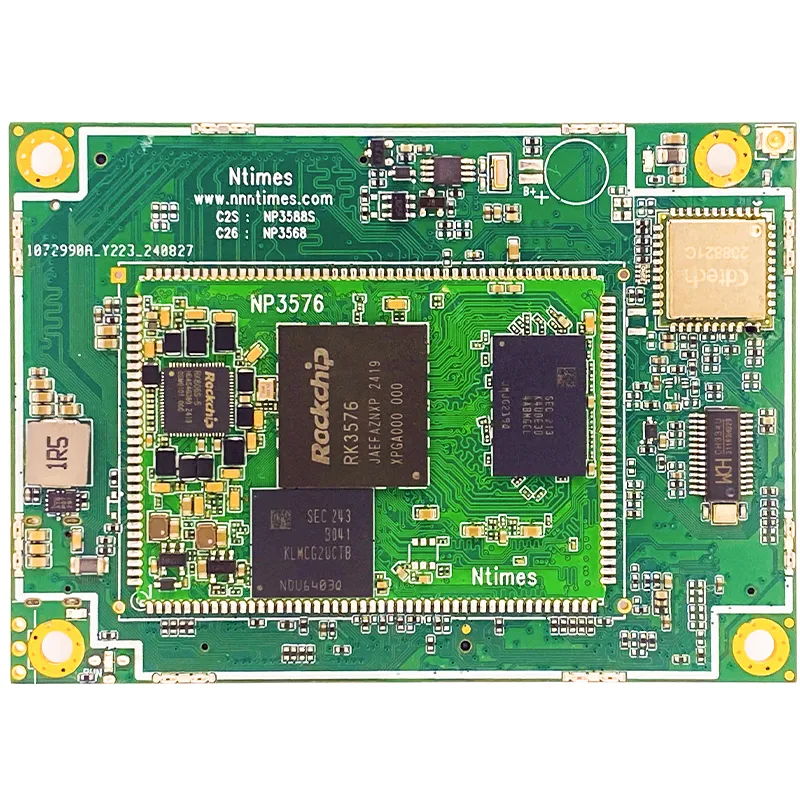

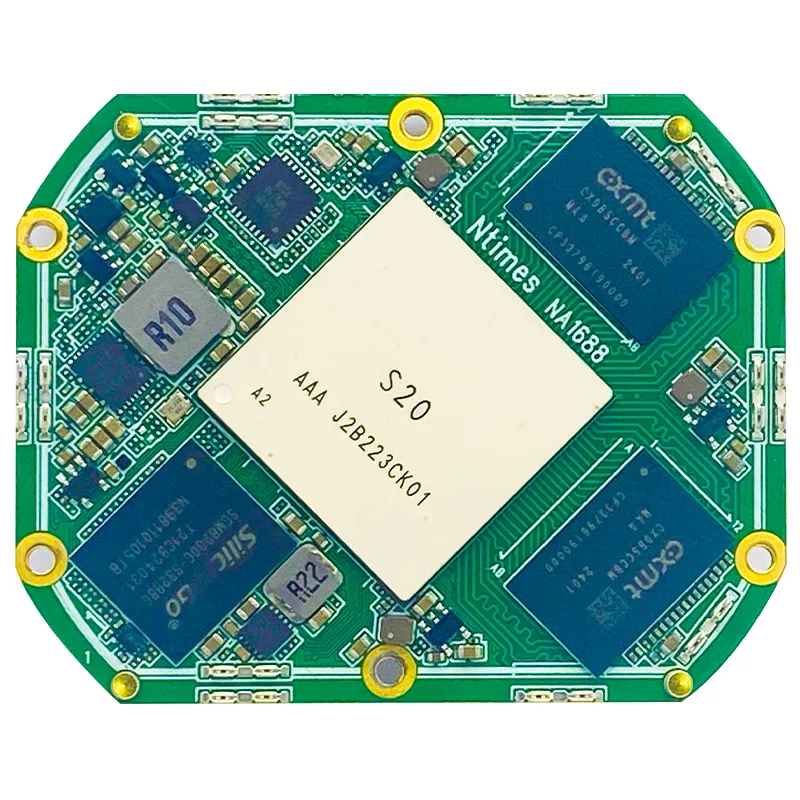

RK1820 – это высокопроизводительный сопроцессор искусственного интеллекта, выпущенный компанией Rockchip, в котором с помощью технологии 3D-многослойной упаковки интегрирована встроенная DRAM с высокой пропускной способностью, Вычислительная мощность NPU достигает 20 TOPS (INT8). Чип спе...

Описание

маркер

RK1820 — это высокопроизводительный сопроцессор искусственного интеллекта, выпущенный компанией Rockchip, в котором с помощью технологии 3D-многослойной упаковки интегрирована встроенная DRAM с высокой пропускной способностью, Вычислительная мощность NPU достигает 20 TOPS (INT8). Чип специально разработан для эффективной работы с большими языковыми и визуальными моделями с размером параметров от 3 до 7 миллиардов на периферийных устройствах (таких как камеры видеонаблюдения, роботы, устройства «умного дома»), обеспечивая локальное вычисление с низкой задержкой и низким энергопотреблением.

RK1820 — это сопроцессор вычислительной мощности, выпущенный компанией Rockchip для эпохи искусственного интеллекта. Он использует передовую технологию 3D-многослойной упаковки и оснащен встроенной DRAM с высокой пропускной способностью (версии 2,5 ГБ и 5 ГБ).

Поддержка моделей: возможность развертывания локальных крупных моделей с количеством параметров до 3 млрд/7 млрд (максимальная длина контекста — 16 тыс. символов)

Производительность: скорость генерации на стороне клиента превышает 100 токенов/с, задержка от клиента до сервера составляет всего 0,1 с

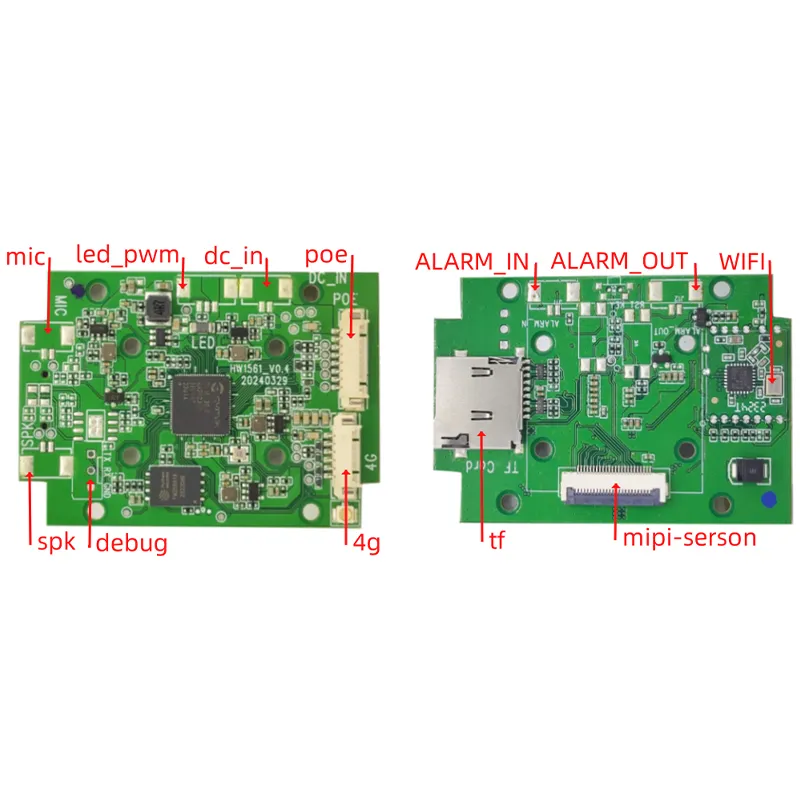

Мультимодальная обработка: поддержка ввода текста, речи, изображений, видео и т. д., совместимость с моделями CNN

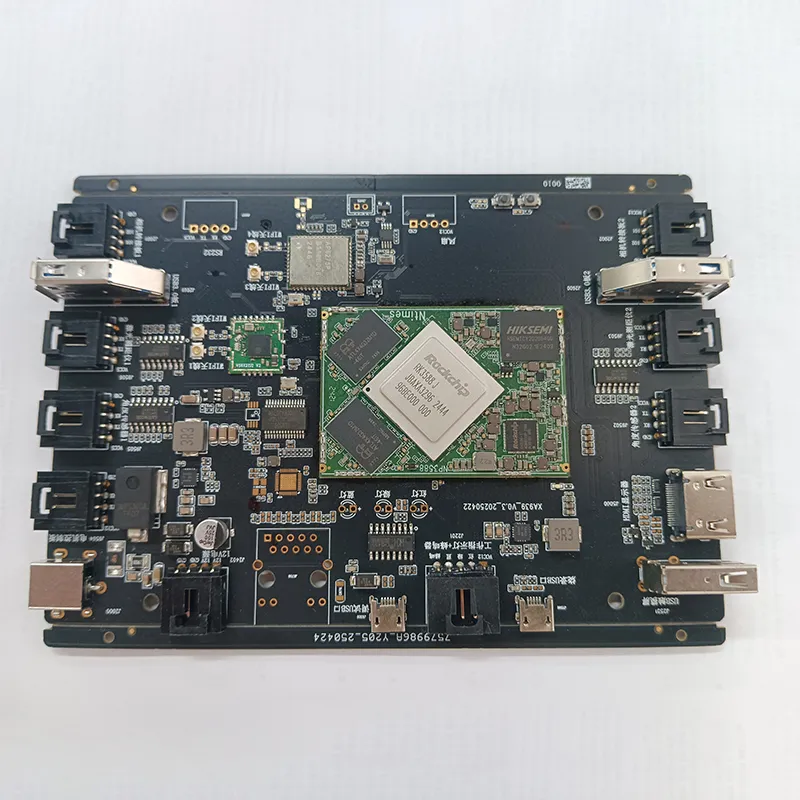

Подключение контроллеров: поддержка интерфейсов PCIe 2.0 / USB 3.0, возможность беспроблемной совместной работы с контроллерами RK3576, RK3588 и др.

Экосистема программного обеспечения: совместимость с основными форматами моделей (HuggingFace, PyTorch, GGUF), API-интерфейс, соответствующий стандартам OpenAI, поддержка вызова из C/Python

Благодаря конструкции, сочетающей высокую пропускную способность и низкое энергопотребление, серия RK1820 преодолела ограничения по энергоэффективности и задержкам при развертывании крупных моделей на периферии, обеспечив ИИ-приложениям отзывчивость, сравнимую с облачными решениями.