Устройство периферийных вычислений для интеллектуальной энергетики

Когда говорят про периферийные вычисления в энергетике, многие сразу представляют себе что-то вроде мини-серверной на подстанции — красивые стойки, мигающие лампочки. На деле же часто всё упирается в пыльный металлический шкаф, где надо втиснуть ?мозги? рядом с релейной защитой, да ещё и чтобы от вибрации и температурных перепадов не посыпалось. Вот об этой разнице между презентацией и реальным монтажом и хочется поговорить.

Что на самом деле скрывается за термином

Интеллектуальная энергетика — это не только умные счётчики. Речь о системах, которые должны принимать решения в реальном времени: балансировка нагрузки с учётом генерации от ВИЭ, прогнозирование отказов оборудования, автоматическое переключение схем. Централизованное облако для таких задач часто слишком медленно и ненадёжно — задержки в сотни миллисекунд неприемлемы, когда речь идёт о стабильности сети. Поэтому вычисления нужно сдвигать ближе к источнику данных — на периферию. Но ?ближе? — это где? На уровне районной подстанции? Или прямо на ячейке КРУ?

Тут начинается первая развилка. Одно дело — обрабатывать данные с десятка датчиков вибрации турбины для предиктивного обслуживания. Другое — анализировать видеопоток с тепловизоров для обнаружения перегрева контактов. Вычислительные потребности, среды исполнения, требования к надёжности — совершенно разные. И под каждую задачу железо должно подбираться специфическое, а не ?универсальный AI-бокс?.

Частая ошибка — пытаться взять готовый промышленный компьютер и просто поставить на него нужный софт. В энергетике свои условия: широкий температурный диапазон (от -40 зимой в Сибири до +60 в закрытом помещении летом), повышенные электромагнитные помехи, требования к длительному сроку службы без обслуживания. Обычные потребительские или даже часть промышленных компонентов быстро выходят из строя. Нужна специализированная платформа, изначально спроектированная под эти условия.

Железо, которое выживает: опыт и грабли

Вот, к примеру, история с одним из наших ранних проектов. Задача — распознавание состояния изоляторов по видео с дрона. Алгоритм написали, точность была приличная. Поставили для обработки на периферии компактный вычислительный модуль на базе популярной мобильной SoC. Всё работало в лаборатории. Вывезли на тестовую ЛЭП — и началось. После часа работы на солнцепёке процессор уходил в троттлинг, производительность падала, кадры терялись. Система охлаждения не была рассчитана на прямой нагрев от солнца в комбинации с собственным тепловыделением. Пришлось пересматривать весь тепловой дизайн, переходить на пассивное охлаждение с расчётом на естественную конвекцию в защищённом корпусе.

Этот кейс хорошо показывает, что устройство периферийных вычислений — это не просто вычислительная мощность в TOPS. Это комплекс: энергоэффективная, но стабильная на всех частотах SoC; надёжная система питания, выдерживающая просадки и всплески напряжения в сетях 0,4 кВ; интерфейсы для подключения к специфическим промышленным шинам и датчикам. Часто забывают про долгосрочную доступность компонентов. Энергетические объекты строятся на десятилетия. Нельзя, чтобы через три года устройство нельзя было починить или модернизировать из-за снятия чипа с производства.

В этом контексте интересен подход таких проектных компаний, как ООО Шэньчжэнь Энтаймс Технолоджи. Они как раз сфокусированы не на продаже готовых ?чёрных ящиков?, а на проектировании и производстве аппаратного обеспечения под конкретные задачи в области периферийного интеллекта. Их деятельность — от модулей до отраслевых продуктов — подразумевает глубокое погружение в условия эксплуатации. Это важно, потому что готовая плата, отлично работающая в роботе-манипуляторе, может оказаться бесполезной на электроподстанции из-за неучтённых требований по EMC.

Сценарии, где это уже не футуризм

Давайте на конкретике. Один из самых понятных сценариев — мониторинг оборудования с помощью компьютерного зрения. Камеры ставятся вдоль конвейера топливоподачи на ТЭЦ или в машинном зале. Устройство периферийных вычислений устанавливается рядом, в шкафу управления. Оно в реальном времени анализирует видео: обнаружение утечек масла, дыма, несанкционированного проникновения людей в опасную зону, контроль показаний аналоговых манометров. Весь raw-видеопоток в центр не передаётся — только события и кадры-подтверждения. Это радикально снижает нагрузку на каналы связи, которые на удалённых объектах часто ограничены.

Другой кейс — анализ данных с микроволновых датчиков расхода пара. Здесь нет видео, но есть высокочастотные выборки данных. На периферии идёт первичная фильтрация, выделение признаков, обнаружение аномалий в спектре сигнала, которые могут указывать на кавитацию или износ трубопровода. И только усреднённые метрики и тревоги уходят на верхний уровень. Это требует уже других вычислительных блоков, оптимизированных для DSP-операций.

Третий, более комплексный пример — локальный энергоузел с солнечными панелями, накопителем и дизель-генератором. Периферийное вычислительное устройство здесь выступает в роли локального диспетчера: на основе прогноза погоды, текущего потребления и состояния аккумуляторов оно в реальном времени решает, что делать — заряжать батареи, отдавать в сеть или запускать генератор. Все решения должны приниматься за миллисекунды, без оглядки на облако, связь с которым может прерваться.

Интеграция: самая большая головная боль

Можно иметь самое совершенное вычислительное ядро, но если оно не может ?поговорить? с существующей АСУ ТП, проект провален. В энергетике царит невероятное разнообразие протоколов: от старых, типа Modbus RTU, до современных OPC UA. И часто на одном объекте они все присутствуют одновременно. Устройство должно либо иметь широкий набор физических интерфейсов (RS-485, Ethernet) и программную поддержку протоколов, либо быть достаточно открытым, чтобы интегратор мог добавить нужный драйвер.

Ещё один тонкий момент — безопасность. Доступ к такому устройству по определению должен быть строго регламентирован. Но с другой стороны, его должны удалённо обслуживать и обновлять. Баланс между закрытостью и управляемостью найти сложно. Часто заказчики требуют аппаратные корневые ключи доверия (HSM), что опять же влияет на выбор платформы и её стоимость.

Здесь опять возвращаешься к важности проектного подхода. Нужно не просто впаять мощный процессор, а продумать всю цепочку: от приёма сырых данных с датчика через аналоговый или цифровой вход, их обработки, принятия локального решения, до передачи результата в SCADA-систему и возможности удалённой диагностики самого устройства. Компании, которые занимаются проектированием и производством отраслевых продуктов интеллектуальных вычислений, как упомянутая ООО Шэньчжэнь Энтаймс Технолоджи, по сути, решают именно эту инженерную задачу ?под ключ? — создают не голое железо, а аппаратную платформу, готовую к встраиванию в сложную среду.

Взгляд вперёд: что будет меняться

Сейчас много шума вокруг AI на периферии. Но в энергетике, мне кажется, ближайший тренд — не столько наращивание TOPS для сверхсложных нейросетей, сколько повышение надёжности, отказоустойчивости и упрощение развёртывания. Устройства должны становиться более ?самостоятельными?: с возможностью самодиагностики, автоматического восстановления после сбоя, работы в деградированном режиме.

Второй момент — стандартизация. Пока каждый производитель предлагает свою экосистему. Хотелось бы видеть больше открытых аппаратных референс-платформ, специфически заточенных под задачи интеллектуальной энергетики, на основе которых разные интеграторы могли бы быстро собирать свои решения. Это снизило бы стоимость и сроки внедрения.

И последнее. Самое важное — это изменение мышления самих энергетиков. Устройства периферийных вычислений перестают быть экзотикой. Они становятся таким же стандартным компонентом цифровой подстанции, как микропроцессорный терминал защиты. И понимание их возможностей и ограничений должно быть у инженеров на местах. Иначе самые совершенные системы будут простаивать или использоваться на 10% от их потенциала. Главная задача сейчас — не создать технологию, а вписать её в ежедневную операционную деятельность, сделать понятной и нужной тому, кто сидит за щитом управления. Вот тогда и получится настоящая интеллектуальная энергетика.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

Мобильный наголовный 3D дисплей

Мобильный наголовный 3D дисплей -

Анализатор сети доступа

Анализатор сети доступа -

Алгоритм разделения ролей

Алгоритм разделения ролей -

Медицинский монитор

Медицинский монитор -

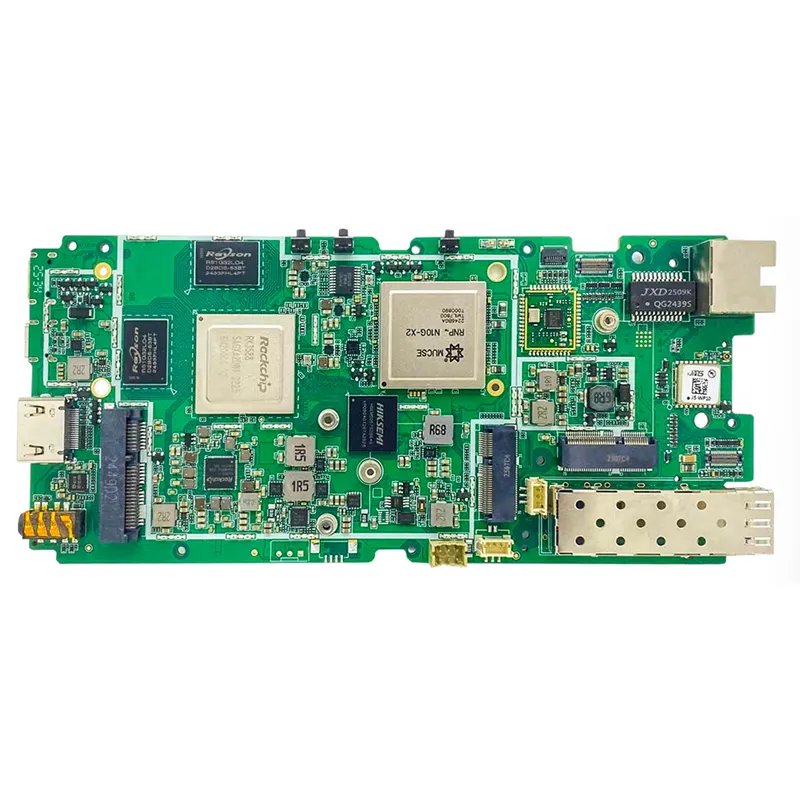

Съемные модули серии NA NA1812CP, NA1684X

Съемные модули серии NA NA1812CP, NA1684X -

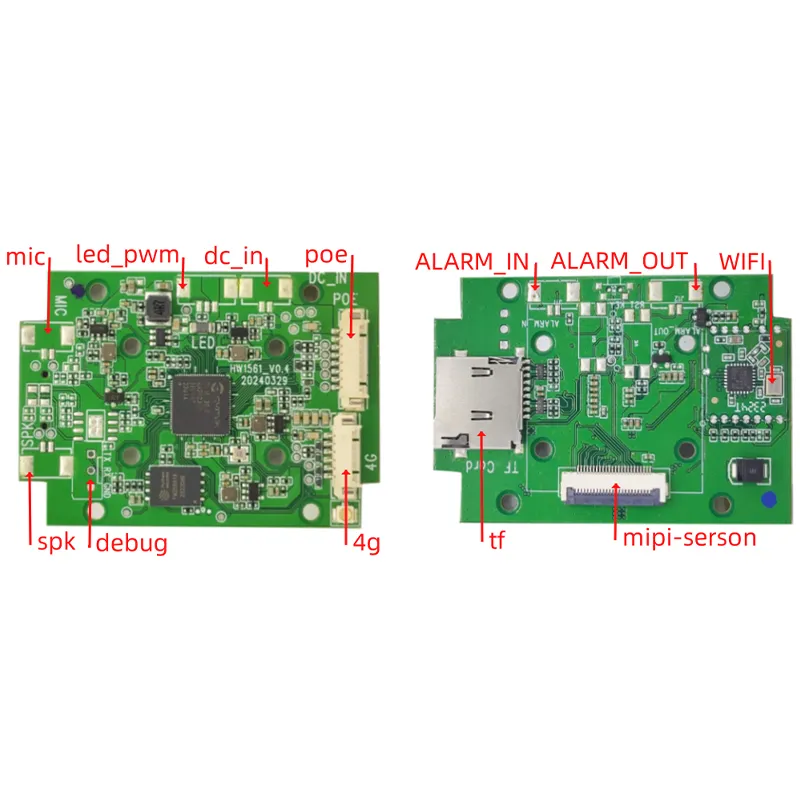

Съемные модули серии C C26,C27,C2S,C28,C216,C6E,C6P

Съемные модули серии C C26,C27,C2S,C28,C216,C6E,C6P -

Локальная платформа видеонаблюдения и интернета вещей

Локальная платформа видеонаблюдения и интернета вещей -

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Интегрированная машина с большой моделью для интеллектуального захвата голоса -

Цифровой домашний шлюз с национальной криптографией

Цифровой домашний шлюз с национальной криптографией -

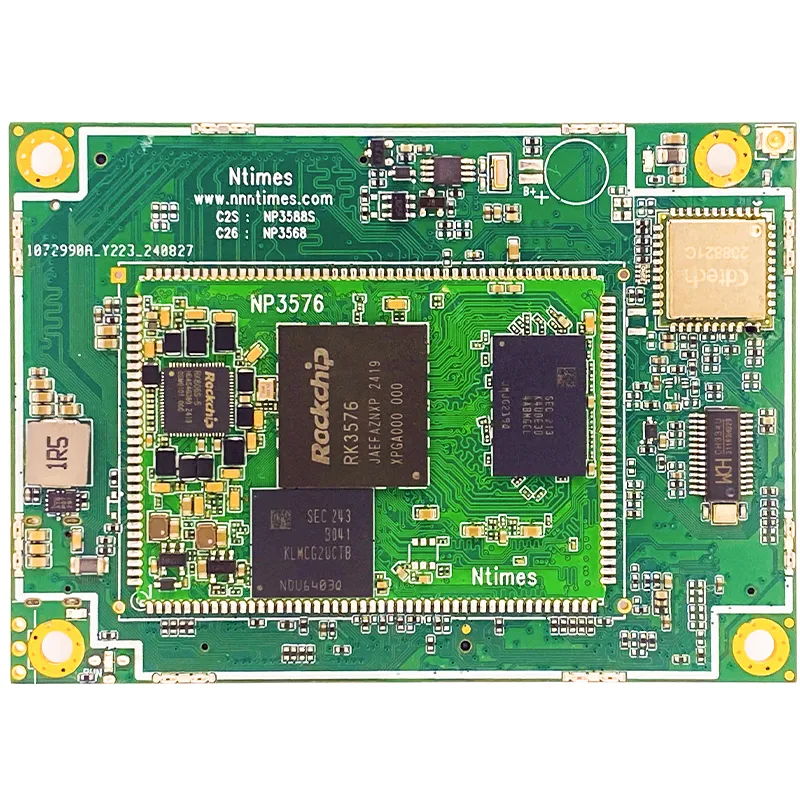

Интеллектуальная платформа 80T/128T

Интеллектуальная платформа 80T/128T -

Планшет для автомобильной диагностики

Планшет для автомобильной диагностики -

Подвесная капсула для БПЛА

Подвесная капсула для БПЛА

Связанный поиск

Связанный поиск- RK3566 SOM

- Высокопроизводительная материнская плата для роботов

- HMD дисплей

- Интеллектуальный модуль безопасности SOM

- Модуль для БПЛА SOM

- Наземная станция управления БПЛА

- RK3588 SOM

- RK3506 SOM

- Индивидуальная настройка решений для Интернета вещей

- Встроенный вычислительный бокс для локальных больших языковых моделей