Моноблок большой AI-модели DeepSeek

Когда слышишь ?Моноблок большой AI-модели DeepSeek?, первое, что приходит в голову — очередной мощный сервер для дата-центра. И вот тут начинается главное заблуждение. Многие, особенно те, кто не сталкивался с внедрением в ?железо?, думают, что большая модель — это исключительно про облако и тонны вычислений где-то далеко. На деле же, самая сложная и интересная задача — это как раз упаковать эти возможности в автономное, периферийное устройство, которое должно работать без постоянного подключения к стеку GPU. И здесь мы уже входим в зону ответственности таких компаний, как ООО Шэньчжэнь Энтаймс Технолоджи. Их сайт nnntimes.ru четко обозначает фокус: развертывание аппаратного обеспечения вычислительной мощности в продукты периферийных интеллектуальных вычислений. То есть, они — как раз те, кто берет модель, вроде DeepSeek, и пытается вдохнуть в нее жизнь внутри робота, дрона или промышленной камеры.

Почему ?моноблок? — это не просто коробка

Термин ?моноблок? в нашем контексте — это не про элегантный компьютер ?всё в одном?. Речь идет о комплексном аппаратно-программном решении. Представьте себе задачу: вам нужно, чтобы автономный складской робот не просто следовал по линии, а в реальном времени анализировал обстановку, распознавал нештатные ситуации (разлитая жидкость, упавший груз) и принимал решения. Для этого ему нужна локальная большая AI-модель, способная к контекстному пониманию, но при этом работающая в условиях жестких ограничений по энергопотреблению, тепловыделению и, конечно, стоимости. Гнать все видеопотоки в облако — неприемлемо из-за задержек и требований к надежности связи.

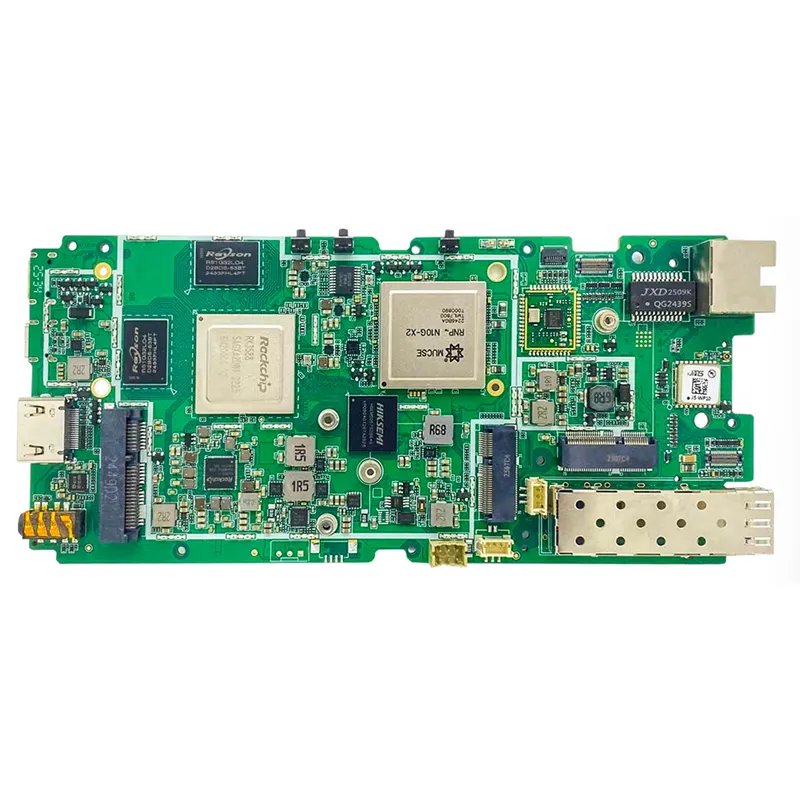

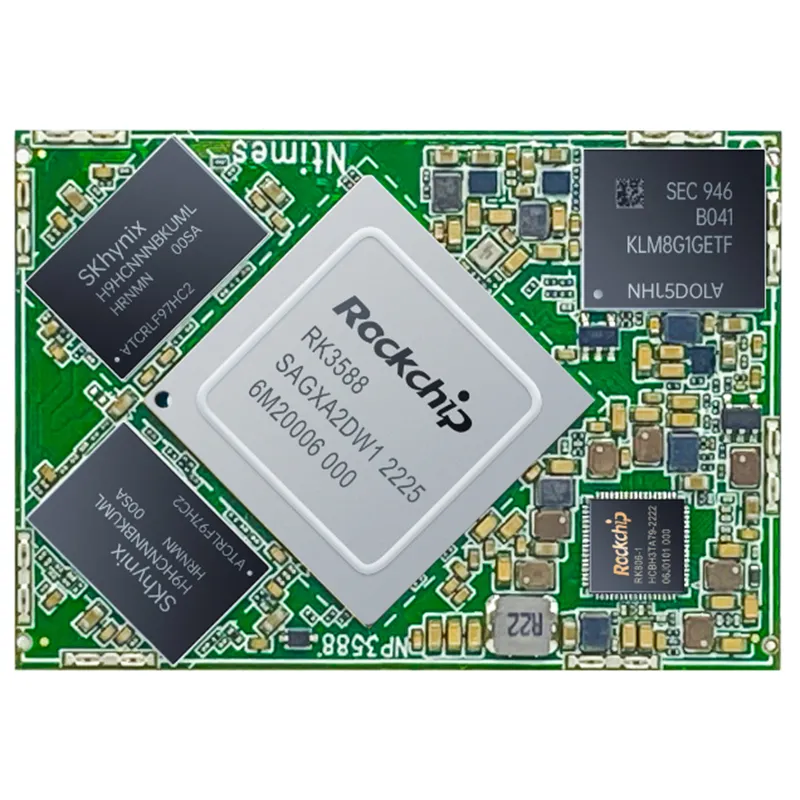

Именно здесь на первый план выходит проектирование. Компания, подобная Энтаймс Технолоджи, не просто берет готовый чип от NVIDIA или другого вендора. Они проектируют модуль или центральный контроллер (центральные контроллеры интеллектуальных вычислений — это как раз их ключевая деятельность), где процессор, память, интерфейсы ввода-вывода и система охлаждения подобраны и сбалансированы под конкретную задачу инференса (вывода) большой модели. Важно не максимальное количество TOPS (триллионов операций в секунду), а эффективность на ватт при работе с определенным типом данных — например, последовательностями изображений высокого разрешения.

С DeepSeek, как с одной из крупных языковых/мультимодальных моделей, история особая. Ее архитектура может быть не такой ?распиаренной?, как у некоторых западных аналогов, но для периферийного развертывания это иногда плюс. Меньше предубеждений, больше гибкости в оптимизации. Хотя, конечно, документация и сообщество — факторы риска. В одном из наших пилотных проектов для медицинского оборудования (томограф с AI-ассистентом) как раз рассматривали адаптацию DeepSeek для анализа протоколов исследований и генерации предварительных заключений. Упор был на низкую задержку и полную конфиденциальность данных внутри аппарата.

Провалы и уроки: когда железо не тянет софт

Хочется верить в магию, но на практике первая интеграция почти всегда проваливается. Помню случай с проектом для ?умной? камеры видеонаблюдения. Задача — не просто детектировать человека, а оценивать его поведение (например, падение, агрессию) с помощью дообученной большой AI-модели. Взяли, казалось бы, мощный вычислительный модуль. Модель, сжатая и квантизированная, в симуляции показывала приемлемые 15 кадров в секунду. Но когда собрали прототип и запустили в термокамере при +40°C, начался троттлинг уже через три минуты. Частота упала до 2-3 кадров. Бесполезно.

Анализ показал, что проблема была не в пиковой производительности чипа, а в архитектуре теплоотвода на нашей плате и в прошивке управления питанием. Память GDDR6 грелась так, что влияла на соседние компоненты. Это классическая ошибка при переходе от ?лабораторного? образца к промышленному дизайну. Пришлось пересматривать всю компоновку печатной платы и заказывать активную систему охлаждения, что увеличило стоимость и габариты. Клиент из сферы безопасности был не в восторге. Такие истории — обычное дело в работе над моноблоком большой AI-модели. Успех определяется не на этапе презентации, а на этапе длительных стресс-тестов в условиях, приближенных к реальным.

Именно поэтому в описании деятельности ООО Шэньчжэнь Энтаймс Технолоджи я вижу ключевые слова: ?проектирование и производство отраслевых продуктов?. Это не сборка из готовых кубиков. Это глубокое погружение в отрасль — будь то автомобильная техника или беспилотные летательные аппараты — и создание решения с нуля, где модель и железо являются частями одного целого.

Сценарии, где это работает: не только распознавание

Часто разговор о периферийном ИИ сводится к компьютерному зрению. Но потенциал большой AI-модели, такой как DeepSeek, локально развернутой, гораздо шире. Возьмем, к примеру, промышленного робота-манипулятора на сборочной линии. Задача — не запрограммировать его на тысячу операций, а дать ему возможность понимать голосовые или текстовые команды оператора на естественном языке: ?возьми деталь A и установи ее в паз B, который немного смещен?. Для этого нужна модель, понимающая контекст, пространственные отношения и способная порождать последовательность действий (план).

Вот здесь моноблок, спроектированный как центральный контроллер интеллектуальных вычислений для этого робота, должен выполнять две тяжелые задачи одновременно: работать с языковой моделью и с системой технического зрения для позиционирования. И делать это с детерминированным временем отклика. В автомобильной технике похожая история, но с добавлением требований функциональной безопасности (ASIL). Модель может использоваться для анализа состояния водителя, прогнозирования поведения других участников движения на основе данных с камер и радаров, но любая задержка или сбой недопустимы.

На сайте nnntimes.ru в сферах применения указаны и медицинское оборудование. Это один из самых сложных, но и самых перспективных путей. Представьте портативный УЗИ-аппарат с AI-ассистентом, который не только показывает изображение, но и в режиме реального времени комментирует возможные аномалии, опираясь на знания, заложенные в большую модель, дообученную на медицинских данных. Конфиденциальность и скорость здесь критичны, что делает облачные решения неприемлемыми. Только локальный моноблок большой AI-модели.

Будущее: конвергенция, а не изоляция

Сейчас много шума вокруг автономных периферийных устройств. Но тренд, который я наблюдаю, — это не изоляция от облака, а умная гибридная архитектура. Тот самый моноблок на периферии берет на себя критичные по времени задачи инференса и базового принятия решений. При этом он может периодически, по надежному каналу, синхронизироваться с облаком, получая обновления модели, передавая агрегированные анонимные данные для дообучения или запрашивая помощь в нестандартной ситуации, которую не может разрешить локально.

Роль компании-интегратора, такой как Энтаймс Технолоджи, в этой схеме становится еще более важной. Нужно проектировать устройство, которое является не конечной точкой, а узлом в распределенной сети. Это требует работы не только с ?железом? и низкоуровневым ПО, но и с сетевыми протоколами, механизмами безопасного обновления и управления жизненным циклом модели на тысячах устройств. DeepSeek или другая большая AI-модель в таком контексте — это уже не статичный артефакт, а динамический компонент, который эволюционирует.

Итог прост. Разговоры о ?мощных AI-моноблоках? будут продолжаться. Но реальная ценность создается там, где инженеры, закатав рукава, решают проблемы теплового дизайна, задержек в памяти, оптимизации под конкретный нейронный оператор и интеграции в жесткие промышленные стандарты. Это и есть та самая ?проектная компания?, о которой говорит ООО Шэньчжэнь Энтаймс Технолоджи. Без этого глубокого погружения любой моноблок с большой моделью останется просто дорогой игрушкой, а не двигателем для следующего витка автоматизации в самых разных отраслях — от роботов до медицинского оборудования.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Интегрированная машина с большой моделью для интеллектуального захвата голоса -

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588 -

Медицинский монитор

Медицинский монитор -

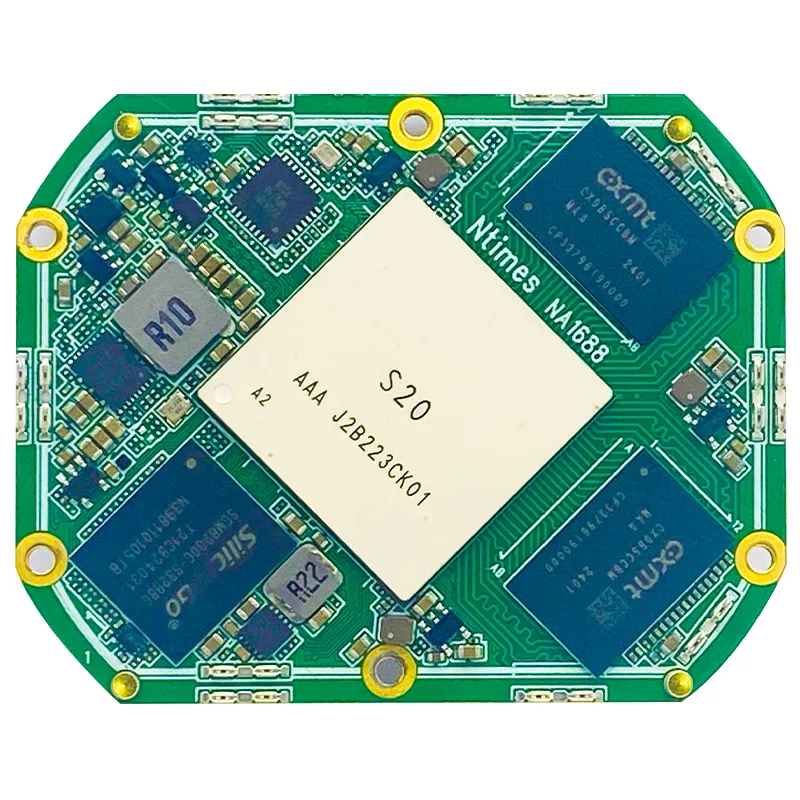

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P -

Подвесная капсула для БПЛА

Подвесная капсула для БПЛА -

Пульт дистанционного управления для БПЛА

Пульт дистанционного управления для БПЛА -

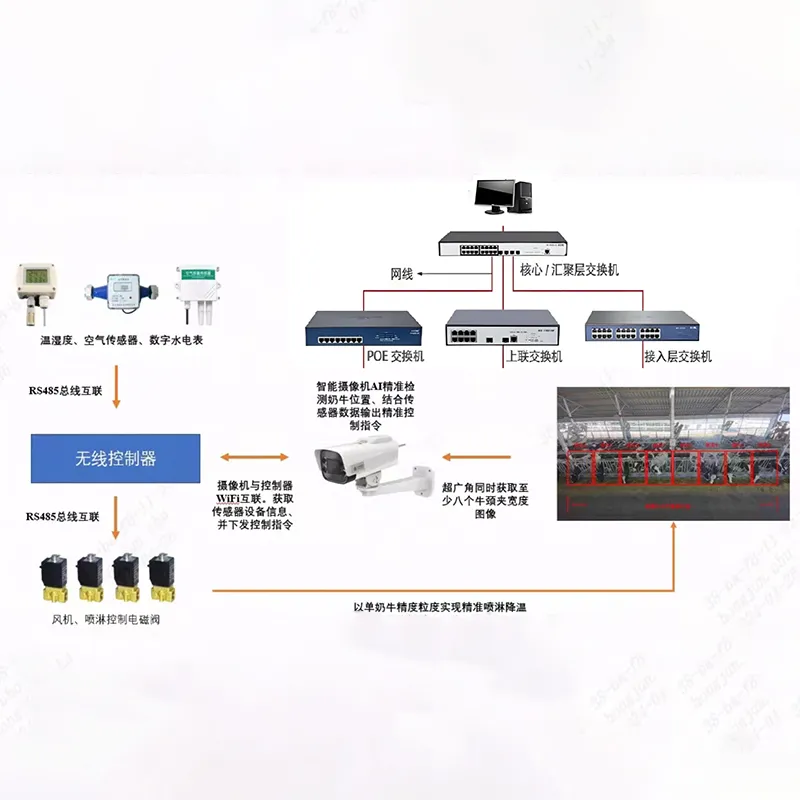

Локальная платформа видеонаблюдения и интернета вещей

Локальная платформа видеонаблюдения и интернета вещей -

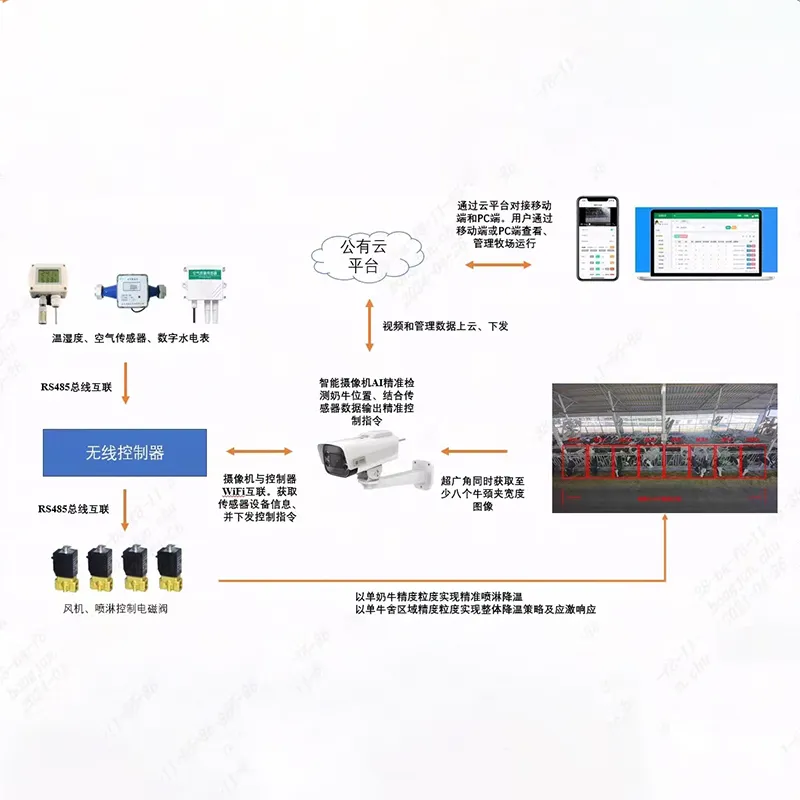

Платформа видеонаблюдения и интернета вещей на общедоступном облаке

Платформа видеонаблюдения и интернета вещей на общедоступном облаке -

Микроскоп для биологических наук

Микроскоп для биологических наук -

Вычислительные боксы серии Z2 Z26,Z27,Z2S,Z28,Z216

Вычислительные боксы серии Z2 Z26,Z27,Z2S,Z28,Z216 -

Блок диагностики OBD для автомобилей

Блок диагностики OBD для автомобилей -

Интегрированная машина с большой моделью для умных фонарных столбов

Интегрированная машина с большой моделью для умных фонарных столбов

Связанный поиск

Связанный поиск- Модуль подвеса (гондолы) для БПЛА

- ST SOM

- Индивидуальная настройка решений для Интернета вещей

- NXP SOM

- Вычислительный бокс DeepSeek

- Бокс периферийных вычислений с ИИ

- Встроенный вычислительный бокс для системы управления БПЛА

- Кастомизация медицинского монитора пациента

- Индивидуальная настройка вычислительной системы для роботов с воплощенным интеллектом

- Ручной анализатор волоконно-оптических сетей 10G