Гарнитура смешанной реальности

Когда слышишь ?гарнитура смешанной реальности?, первое, что приходит в голову — это, конечно, HoloLens или, может, последние шумихи вокруг Apple Vision Pro. Но в реальной промышленной или проектной работе всё часто упирается не в блестящий маркетинг, а в то, как эта самая гарнитура смешанной реальности встраивается в конкретный вычислительный контур, особенно на периферии. Многие до сих пор считают, что MR — это в первую очередь иммерсивный контент, игровая или развлекательная среда. Это, пожалуй, самый распространённый пробел в понимании. На деле же, ключевой вызов — это аппаратно-программная связка, где гарнитура становится не просто дисплеем, а интеллектуальным терминалом, потребляющим результаты вычислений с периферийных узлов. И вот здесь начинается настоящая работа.

От концепции к ?железу?: где кроется разрыв

В наших проектах, скажем, для промышленного контроля или удалённой технической поддержки, мы быстро столкнулись с тем, что готовые потребительские MR-решения часто не подходят. Не в плане качества картинки — с этим как раз всё хорошо. Проблема в задержках, тепловыделении и, что критично, в интерфейсах для интеграции с внешними вычислительными модулями. Гарнитура должна быть лёгкой, но при этом где-то должен выполняться тяжёлый компьютерный зрение или рендеринг сложных CAD-моделей. Ставить мощный процессор прямо на голову — тупиковый путь с точки зрения эргономики и автономности.

Поэтому наша логика сместилась в сторону архитектуры, где гарнитура смешанной реальности выступает в роли тонкого клиента. Основная нагрузка ложится на внешний вычислительный модуль — тот самый периферийный интеллектуальный контроллер. Мы плотно работали, например, над интеграцией с платформами типа NVIDIA Jetson. Задача — обеспечить стабильную, низколатентную передачу потока обработанных данных (не просто видео, а уже обогащённого метками, 3D-объектами) на дисплей гарнитуры. Это не тривиально. Стандартные беспроводные протоколы типа Wi-Fi 6 помогают, но в условиях промышленного цеха с помехами приходится закладывать серьёзный запас и думать о компрессии без потерь критичных данных.

Здесь к месту вспомнить опыт коллег из ООО Шэньчжэнь Энтаймс Технолоджи. Их профиль — как раз развёртывание аппаратного обеспечения вычислительной мощности в продукты периферийных интеллектуальных вычислений. Мы изучали их подход к построению центральных контроллеров. Для MR-гарнитуры в промышленном исполнении такой контроллер — это не просто мини-ПК. Это устройство, которое должно быть спроектировано с учётом требований к надёжности, диапазону рабочих температур и, что важно, с продуманными интерфейсами для датчиков (камеры глубины, IMU с гарнитуры), которые стекаются для обработки. Их сайт https://www.nnntimes.ru отражает этот фокус на аппаратную часть для ИИ-решений, что часто упускается из виду в погоне за софтверными фичами.

Провалы и инсайты: когда ?умный? шлем оказывается слепым

Был у нас проект с обучением сборке сложных агрегатов. Идея: работник в гарнитуре смешанной реальности видит пошаговые инструкции, наложенные прямо на детали. Всё красиво в демо. А на реальном объекте — провал. Почему? Освещение. Контент, который прекрасно отображался при ровном студийном свете, в полутьме цеха с контровым светом от окон просто терялся. Датчики отслеживания пространства (SLAM) сбивались. Получилось, что мы нагрузили периферийный модуль не только рендерингом, но и постоянной коррекцией карты окружения в реальном времени, что съедало ресурсы, предназначенные для основной логики.

Этот кейс заставил серьёзно пересмотреть требования к датчикам самой гарнитуры. Недостаточно иметь камеру для пасспросу. Нужна robust-ная система, способная работать в неконтролируемых условиях. Пришлось углубиться в тему сенсорного синтеза — комбинирование данных с камер видимого спектра, инфракрасных датчиков и лидаров. И здесь снова встаёт вопрос о вычислительной архитектуре. Часть этой обработки можно и нужно делать локально, на самой гарнитуре, чтобы снизить зависимость от канала связи, но это требует специально спроектированных SoC (систем на кристалле).

Тут видится прямая связь с деятельностью компаний, занимающихся модулями интеллектуальных вычислений. Проектирование отраслевых продуктов, как у ООО Шэньчжэнь Энтаймс Технолоджи, подразумевает как раз создание таких аппаратных платформ, где баланс между производительностью, энергопотреблением и надёжностью выверен под конкретную задачу — будь то робот, дрон или та же промышленная гарнитура смешанной реальности. Их работа — обеспечить ?мозги?, которые могут обработать сырые данные с сенсоров гарнитуры и быстро вернуть ей готовую для отображения семантическую информацию.

Автомобиль, медицина, безопасность: где MR — не игрушка, а инструмент

Если отойти от промышленности, очень показательная область — автомобильные испытания. Пилот в шлеме смешанной реальности может видеть виртуальные препятствия, наложенные на реальный испытательный полигон. Это требует невероятно низкой задержки и точного позиционирования. Вычислительный модуль здесь должен быть, по сути, частью бортовой системы автомобиля, обрабатывая данные GPS, лидаров автомобиля и данные с шлема. Это уже уровень интеграции, который требует совместной разработки с автопроизводителями. Просто взять готовую гарнитуру с полки не выйдет.

В медицинских симуляторах — другая история. Точность и детализация виртуальных объектов (органов, инструментов) критична. Но также важна и стерильность, невозможность использовать стандартные контроллеры. Здесь перспективны системы отслеживания взгляда и жестов. И опять — вся эта обработка жестов, рендеринг высокополигональных биологических моделей в реальном времени — ложится на внешний вычислительный блок. Тот самый ?периферийный интеллектуальный контроллер?, проектированием которого занимаются упомянутые компании. Это уже не просто проецирование картинки, это создание полноценной интерактивной физической симуляции, результат которой выводится в MR-интерфейс.

В сфере безопасности — например, для координации действий спецподразделений — важна не только передача видео с камеры одного бойца в шлем другого, но и наложение тактической информации (планы зданий, позиции), причём в условиях возможного подавления сигналов. Это диктует необходимость в mesh-сетях между самими гарнитурами и их вычислительными носимые модулями, которые могут работать автономно. Архитектура становится распределённой и более сложной.

Будущее: конвергенция на периферии сети

Итак, куда всё движется? Моё ощущение, что будущее гарнитуры смешанной реальности как профессионального инструмента — за её полным ?растворением? в экосистеме периферийных вычислений. Сама гарнитура будет всё более тонким и эргономичным устройством с минимумом локальной логики. Её ?интеллект? будет определяться подключаемым или сетевым вычислительным модулем. Это как смартфон и облако, только здесь ?облако? — это персональный или групповой вычислительный узел в непосредственной близости.

Это открывает путь к большей стандартизации интерфейсов между сенсорным блоком (гарнитурой) и блоком обработки. И вот здесь как раз поле для деятельности таких инженерных компаний, как ООО Шэньчжэнь Энтаймс Технолоджи. Их специализация на проектировании и производстве отраслевых продуктов интеллектуальных вычислений идеально ложится в эту парадигму. Они могут создавать унифицированные вычислительные платформы, к которым через стандартизированные интерфейсы могут подключаться различные MR-гарнитуры, оптимизированные под свои задачи (лёгкие — для долгой работы, защищённые — для опасных сред, с высоким разрешением — для медицины).

В итоге, разговор о гарнитуре смешанной реальности давно перестал быть разговором об одном устройстве. Это разговор о связке: специализированный дисплей-шлем + мощный, адаптированный к условиям эксплуатации вычислительный модуль на периферии сети. Успех внедрения зависит от того, насколько бесшовно и надёжно работает эта связка. И именно над этой ?невидимой? частью айсберга — аппаратным обеспечением интеллектуальных вычислений — идёт основная и самая сложная работа. Та, что не видна в промо-роликах, но без которой все эти голограммы в воздухе так и останутся красивой картинкой.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

Вычислительные боксы Z4,Z6E,Z6P 32T,80T,128T

Вычислительные боксы Z4,Z6E,Z6P 32T,80T,128T -

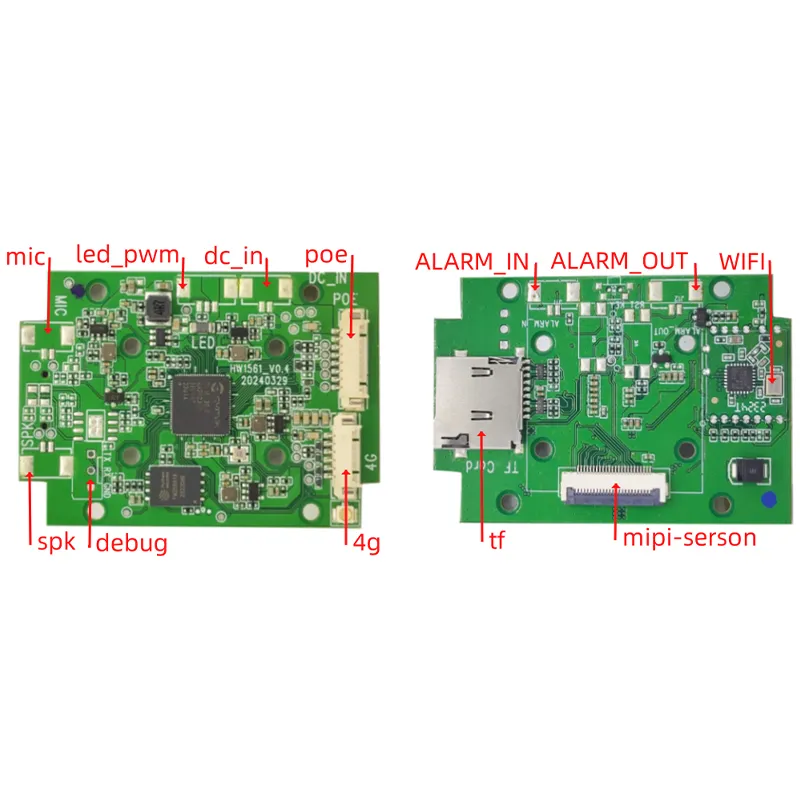

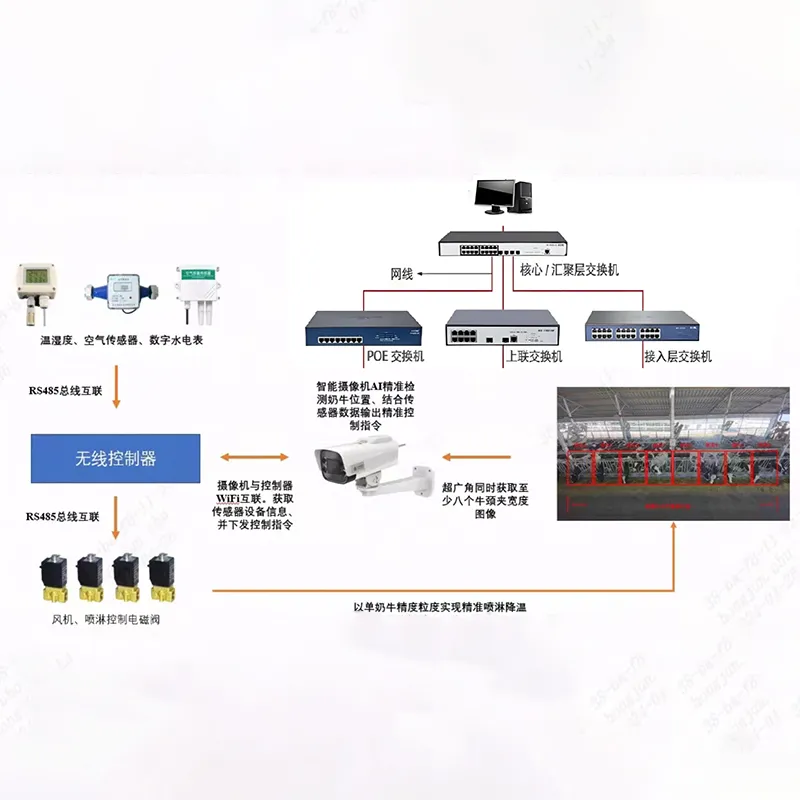

Локальная платформа видеонаблюдения и интернета вещей

Локальная платформа видеонаблюдения и интернета вещей -

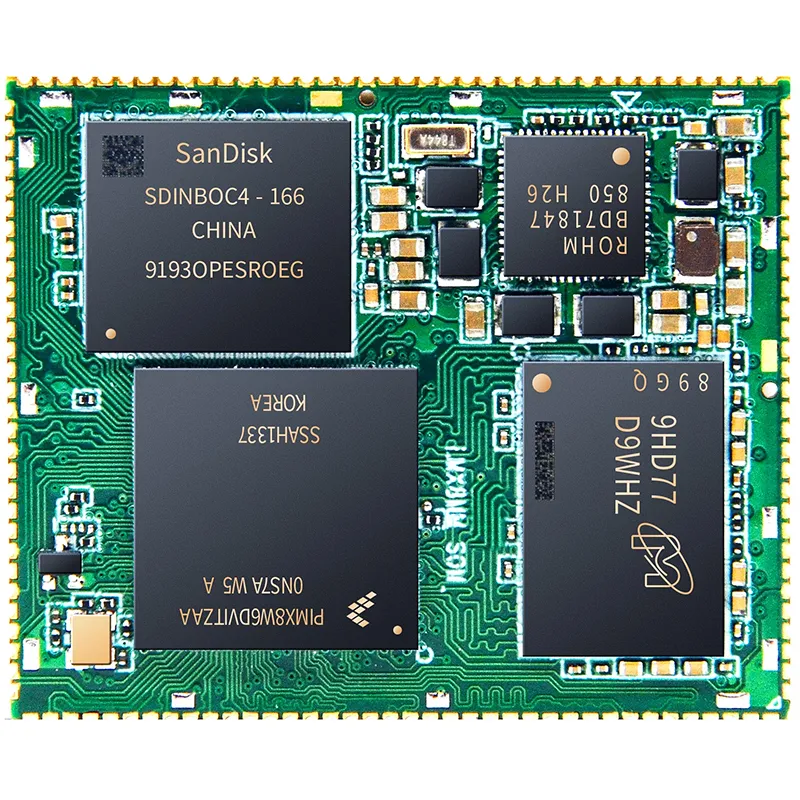

Платформенные модули NP серии Европа-Америка NP8MM, NP8MP, NP93, NS135

Платформенные модули NP серии Европа-Америка NP8MM, NP8MP, NP93, NS135 -

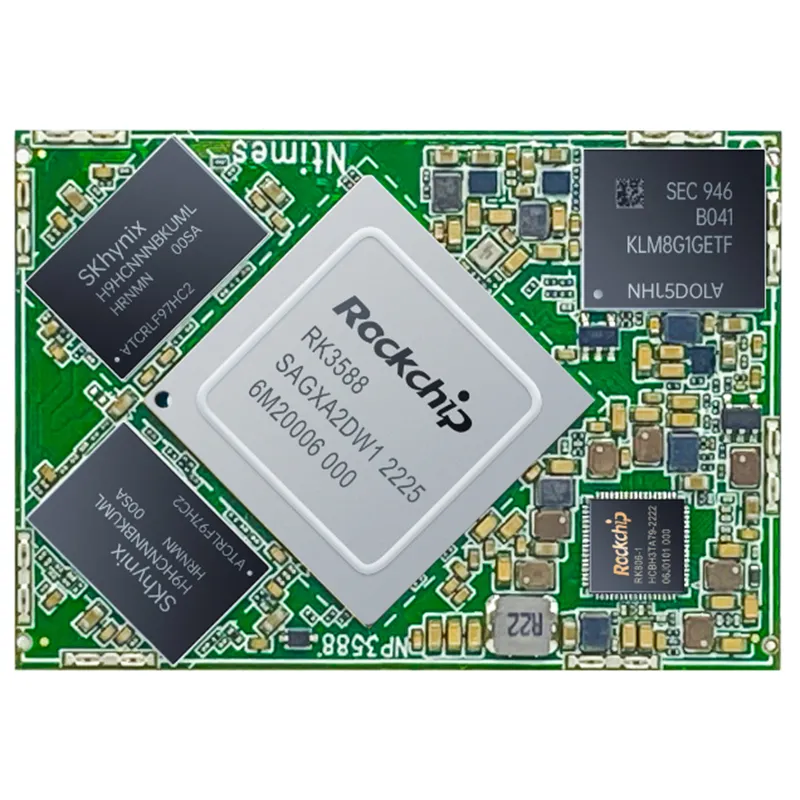

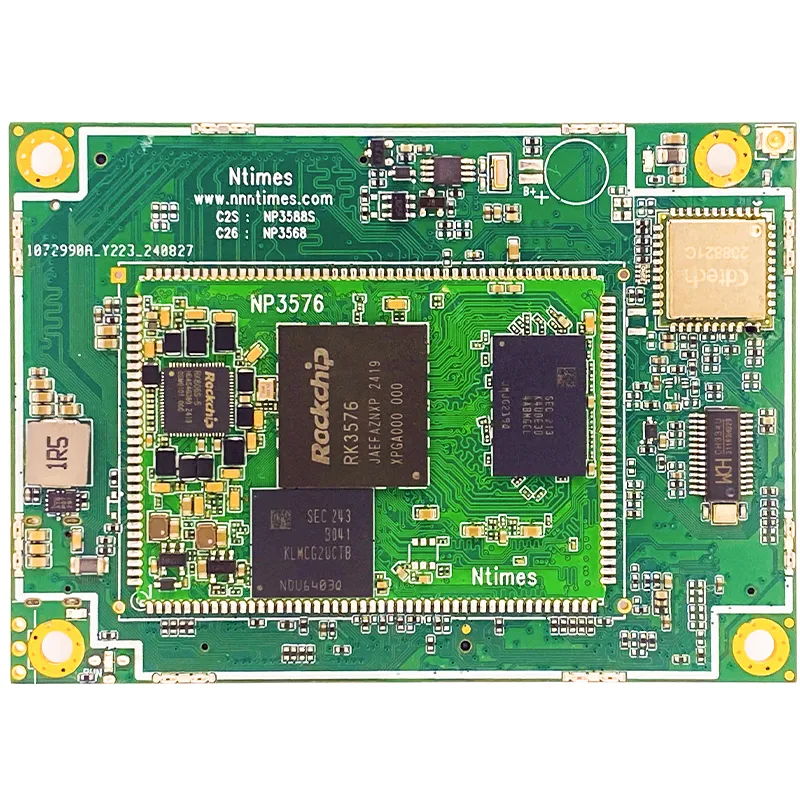

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588 -

Вычислительные боксы серии Z9 Z96,Z98,Z97,Z9S

Вычислительные боксы серии Z9 Z96,Z98,Z97,Z9S -

Пульт дистанционного управления для БПЛА

Пульт дистанционного управления для БПЛА -

Наземная станция для БПЛА AheadX

Наземная станция для БПЛА AheadX -

Съемные модули серии C C26,C27,C2S,C28,C216,C6E,C6P

Съемные модули серии C C26,C27,C2S,C28,C216,C6E,C6P -

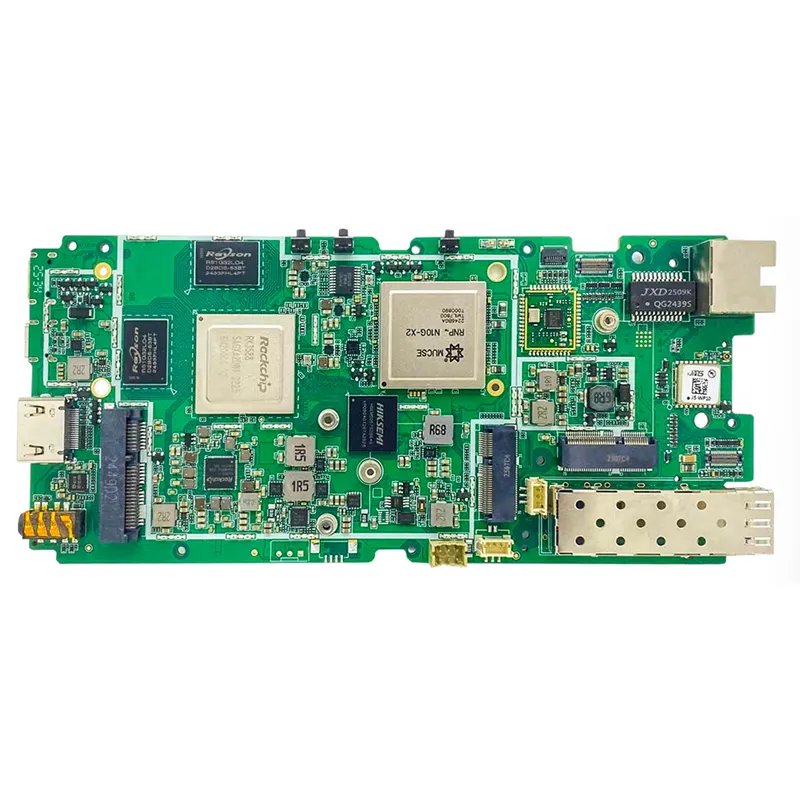

Анализатор сети доступа

Анализатор сети доступа -

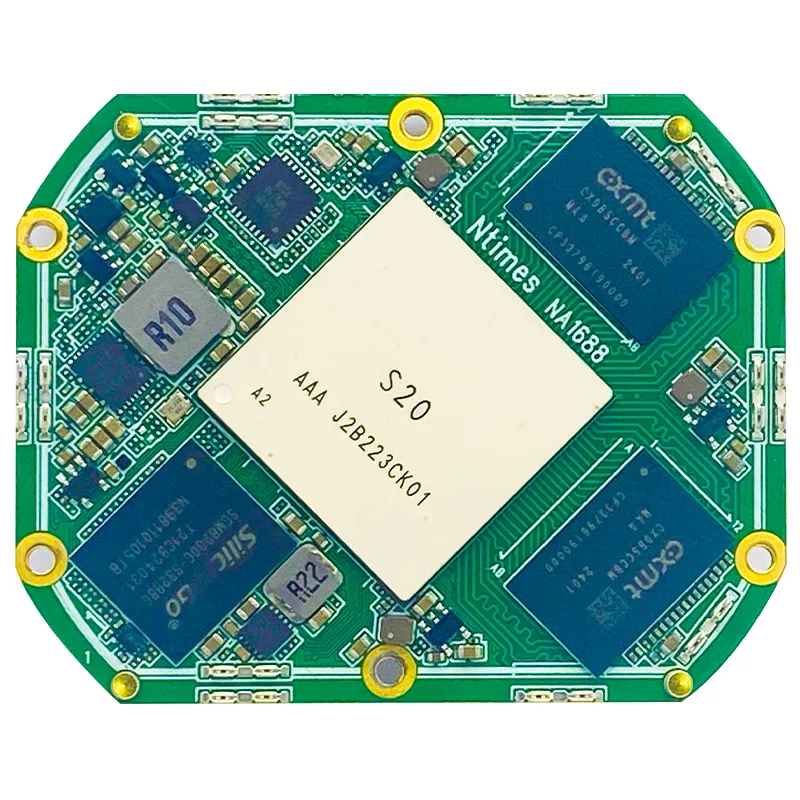

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P -

Интеллектуальная платформа 80T/128T

Интеллектуальная платформа 80T/128T -

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Связанный поиск

Связанный поиск- оборудование для управления бпла

- Встроенный вычислительный бокс для 16 каналов HD-видеокамер

- БПЛА для охранного наблюдения и мониторинга

- Ручной анализатор волоконно-оптических сетей

- Бокс вычислений для БПЛА

- Интеллектуальное устройство для угольных шахт

- Компактный встроенный вычислительный бокс

- Кастомизация решений

- Бокс периферийных вычислений с 5G

- Кастомизация промышленного планшета