Встроенный вычислительный бокс для анализа транспортного потока

Когда слышишь про встроенный вычислительный бокс, многие сразу представляют защищённый компьютер в герметичном корпусе, который ставят на перекрёстке. Но суть не в корпусе. Суть в том, чтобы аналитика — подсчёт, классификация, отслеживание трафика — происходила прямо на краю сети, в этом самом боксе, а не где-то в облаке. И вот здесь начинаются все сложности и подводные камни, о которых в спецификациях часто умалчивают.

От идеи до столба: где теория расходится с практикой

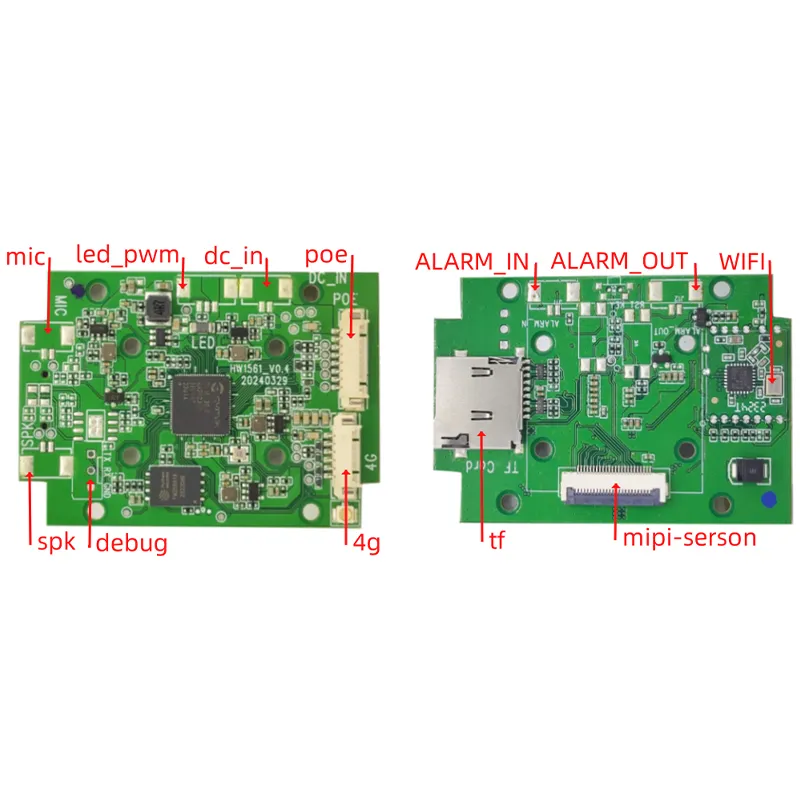

В теории всё просто: берёте мощный SoC (часто на базе архитектуры ARM, тот же Nvidia Jetson или что-то от Rockchip), упаковываете его в корпус с пассивным или гибридным охлаждением, добавляете интерфейсы для камер (PoE, MIPI), связи (4G/5G, Ethernet) и — вперёд. Но на практике... Я помню один из первых наших проектов с партнёрами, кажется, для мониторинга трафика на въезде в логистический парк. Мы тогда поставили боксы на базе довольно производительного чипа. Алгоритмы детекции работали отлично в лаборатории при +20°C. А на улице, в июльскую жару, под прямым солнцем, корпус раскалялся, начинался троттлинг, и кадры с камер просто переставали обрабатываться в реальном времени. Пропускная способность алгоритма падала катастрофически. Пришлось срочно пересматривать конструктив теплоотвода и вносить изменения в прошивку для более агрессивного управления частотой процессора. Это был урок: расчёт теплового режима — это не второстепенная задача, а одна из ключевых.

Ещё один момент — питание. В городской инфраструктуре с этим часто бывает ?как получится?. Стабильность напряжения оставляет желать лучшего, бывают скачки. Просто поставить блок питания на 12В — недостаточно. Нужна качественная цепь защиты, фильтрации, а в идеале — встроенный стабилизатор и возможность работы в широком диапазоне входных напряжений. Иначе первые же грозы или проблемы на подстанции выведут устройство из строя. Мы в ООО Шэньчжэнь Энтаймс Технолоджи после нескольких таких инцидентов стали обязательно включать в свои встроенные вычислительные боксы защищённые промышленные блоки питания с запасом по мощности и варисторами.

И конечно, монтаж. Казалось бы, что тут сложного? Но когда подрядчики на месте вешают короб на столб, им главное — чтобы держалось. А про ориентацию камерных портов, доступ к разъёмам для сервисного обслуживания или вентиляционным отверстиям часто ?забывают?. Приходится делать максимально ?дуракоустойчивый? дизайн креплений и разметку на корпусе, а в документации расписывать процесс установки с картинками. Это тоже часть работы над продуктом, которую не оценишь, пока сам не столкнёшься с заменой модуля памяти на трёхметровой высоте в -15°C.

?Мозги? бокса: выбор платформы — компромисс без конца

Сердце любого такого устройства — вычислительная платформа. Выбор огромен: от простых CPU с акселераторами VPU для кодирования видео до GPU-ориентированных модулей для сложных нейросетей. Для анализа трафика, если мы говорим не просто о детекции движения, а о классификации ТС (грузовик/легковой/автобус), определении скорости, трекинге траекторий в зоне пересечения нескольких камер — нужна уже серьёзная производительность в TOPS (триллионов операций в секунду).

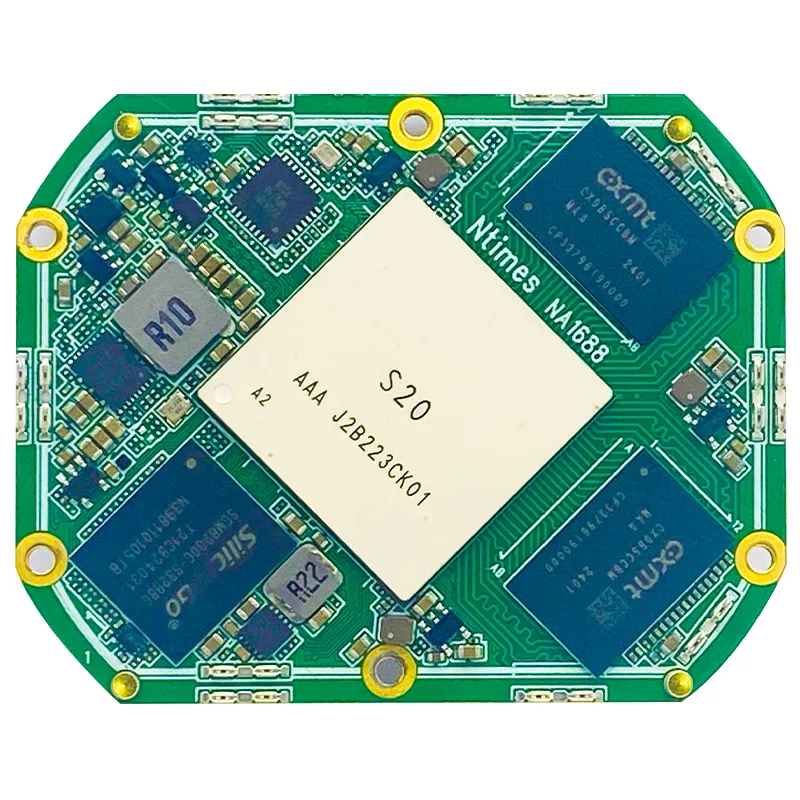

Мы часто экспериментировали. Была попытка использовать универсальные x86-платформы — мощно, много памяти, привычная среда. Но их аппетиты по энергопотреблению и тепловыделению для уличного бокса часто неприемлемы. ARM-архитектура, особенно в связке с NPU (нейропроцессорами), как у многих современных чипов от Qualcomm, HiSilicon, оказалась золотой серединой. Но и тут свои нюансы. Поддержка программного стека, драйверов для конкретных камер, оптимизация библиотек для инференса (TensorFlow Lite, OpenVINO) — на это уходят месяцы работы инженеров. Иногда проще взять готовый модуль, как мы делаем в своих разработках, например, на базе процессоров с интегрированным AI-ускорителем. Это даёт предсказуемую производительность и, что критично, стабильность.

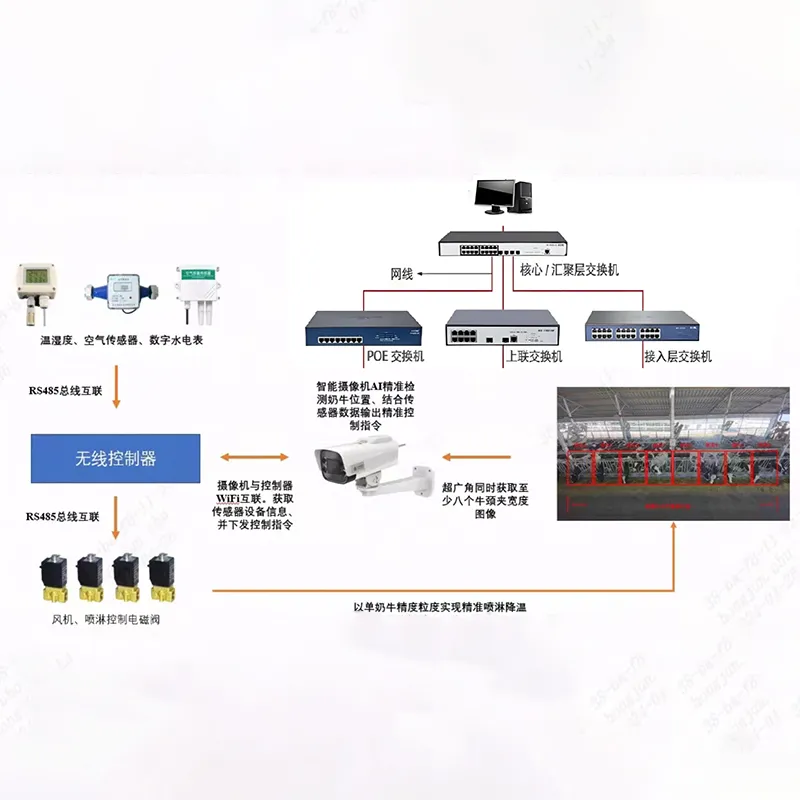

Один из наших проектов для системы ?умный перекрёсток? как раз построен на таком подходе. В встроенный вычислительный бокс мы установили свой же модуль интеллектуальных вычислений на базе процессора с мощным NPU. Задача — в реальном времени обрабатывать потоки с 4 камер, выделять объекты, классифицировать их и передавать на центральный контроллер интеллектуальных вычислений (который, кстати, тоже наша разработка) только метаданные: тип объекта, координаты, скорость. Это снимает нагрузку с центрального сервера и снижает требования к каналу связи. Но чтобы добиться задержки менее 100 мс на обработку кадра, пришлось сильно оптимизировать нейросетевую модель, жертвуя в чём-то точностью ради скорости. Это вечный trade-off.

Программная начинка: то, что не купишь готовым

?Железо? — это только полдела. Самое интересное (и сложное) начинается с софта. Готовых, идеально подходящих под любую задачу прошивок для анализа трафика не существует. Есть SDK от производителей чипов, есть фреймворки, но собрать из этого работающий продукт — отдельное искусство.

Например, управление конвейером обработки данных с нескольких камер. Если делать это наивно, в одном потоке, то производительность будет упорно стремиться к нулю. Приходится выстраивать многопоточные конвейеры, где захват кадра, препроцессинг, инференс нейросети и постобработка — это отдельные стадии, работающие параллельно. И всё это должно стабильно работать неделями и месяцами без перезагрузки. Память утекает? Потоки зависают? Это наши главные головные боли на этапе отладки.

Ещё один пласт проблем — совместимость с камерами. Казалось бы, стандарты RTSP/ONVIF должны всё упростить. Но на деле каждый производитель камер немного ?допиливает? стандарт под себя. Возникают проблемы с форматами потоков (H.264 vs H.265), с профилями кодирования, с поддержкой разрешений. Часто приходится на стороне бокса реализовывать ?костыли? для работы с конкретными моделями камер, которые уже закуплены заказчиком и вмонтированы в инфраструктуру. В идеале, конечно, формировать рекомендации по камерам или поставлять готовые комплекты. На сайте nnntimes.ru в разделе наших продуктов мы как раз стараемся указывать протестированные и рекомендованные модели периферийного оборудования.

И, конечно, обновления. Как доставить новую версию прошивки на сотни разбросанных по городу устройств? Через сотовую сеть, которая может быть нестабильна? Нужен механизм отказоустойчивых обновлений с проверкой целостности и возможностью отката. Мы реализовали это через собственный агент на устройстве, который связывается с системой управления (она может быть развёрнута у заказчика) и загружает обновления по частям, с контрольными суммами. Если что-то пошло не так, бокс продолжает работать на старой версии. Это неглавная функция, но без неё эксплуатация превращается в кошмар.

Связь с миром: данные должны куда-то уходить

Сам по себе встроенный вычислительный бокс для анализа транспортного потока ценность даёт только когда его данные интегрируются в общую систему. А для этого нужна связь. Проводной Ethernet — это хорошо, но не всегда возможно проложить кабель к каждому столбу. Поэтому беспроводные модули (4G/LTE, а теперь уже и 5G) — must-have для большинства уличных решений.

Но и здесь не всё гладко. Сотовая связь в городе, особенно в подземных переходах или тоннелях, может пропадать. Значит, на стороне бокса нужен буфер для временного хранения данных (метаданных или даже ключевых кадров) и механизм их отправки при восстановлении связи. Объём этого буфера — ещё один параметр для расчёта. Если связь пропадает на час — это одно, если на сутки — совсем другое.

Протоколы передачи — тоже тема для дискуссии. MQTT стал де-факто стандартом для IoT, он лёгкий и подходит для телеметрии. Но для передачи сжатых видеосниппетов по событиям (например, ДТП или нарушение) иногда используют HTTP(S) или даже специализированные протоколы. Важно минимизировать overhead и обеспечить безопасность (TLS). Мы в своих системах чаще используем гибридный подход: MQTT для служебных сообщений и состояния, а для ?тяжёлых? данных — отдельный канал.

И нельзя забывать про безопасность. Устройство, висящее на столбе, — потенциальная точка входа в сеть заказчика. Обязательны firewall, отключение неиспользуемых сетевых служб, регулярное обновление для устранения уязвимостей. Многие пренебрегают этим на этапе проектирования, а потом сталкиваются с проблемами при приёмке у служб информационной безопасности.

От прототипа к продукту: путь, который мы прошли

Глядя сейчас на наши серийные встроенные вычислительные боксы, которые работают на десятках объектов, сложно представить, с чего мы начинали. Первые прототипы были собраны буквально ?на коленке?: плата разработчика в пластиковом корпусе с кулером от компьютера. Они годились только для демонстрации возможностей алгоритма в помещении.

Переход к промышленному дизайну — это отдельная эпопея. Подбор алюминиевого сплава для корпуса, который обеспечит и теплоотвод, и защиту от влаги (IP67 — наш стандарт для уличного исполнения), и стойкость к ультрафиолету. Конструирование печатной платы с учётом всех помех, которые могут возникнуть от соседства силовых цепей и высокочастотных линий передачи данных. Сертификация (в том числе по электромагнитной совместимости). Всё это — задачи, которые ООО Шэньчжэнь Энтаймс Технолоджи как компания, специализирующаяся на проектировании и производстве отраслевых продуктов интеллектуальных вычислений, решает комплексно. Мы не просто сборщики, мы проходим весь цикл: от идеи и выбора компонентов до серийного производства и поддержки.

Один из ключевых моментов — создание инструментов для техподдержки и диагностики. Когда устройство в поле, нужно понимать, что с ним происходит. Мы добавили в прошивку удалённый доступ (через безопасный туннель) для сбора логов, мониторинга температуры, загрузки CPU/NPU, состояния связи. Это резко сократило время на диагностику проблем. Иногда проблема оказывается не в нашем боксе, а, например, в том, что камера сбилась или её объектив забрызган грязью. Наши алгоритмы теперь могут детектировать и такие события (резкое падение ?качества? изображения) и отправлять предупреждение.

Сейчас мы смотрим в сторону ещё большей интеграции. Встроенный вычислительный бокс постепенно перестаёт быть изолированным устройством. Он становится частью распределённой вычислительной сети на периферии (edge computing). В перспективе — взаимодействие между соседними боксами для координации анализа на участке дороги, предсказания заторов, более сложных сценариев. Но это уже следующий виток развития, где нужны будут и новые аппаратные мощности, и более сложное программное обеспечение. Работа, как видите, не заканчивается никогда.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

Планшет для автомобильной диагностики

Планшет для автомобильной диагностики -

Наголовный 4K гигантский экран 3D плеер

Наголовный 4K гигантский экран 3D плеер -

Мобильный наголовный 3D дисплей

Мобильный наголовный 3D дисплей -

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P -

Программный каркас

Программный каркас -

Наземная станция для БПЛА AheadX

Наземная станция для БПЛА AheadX -

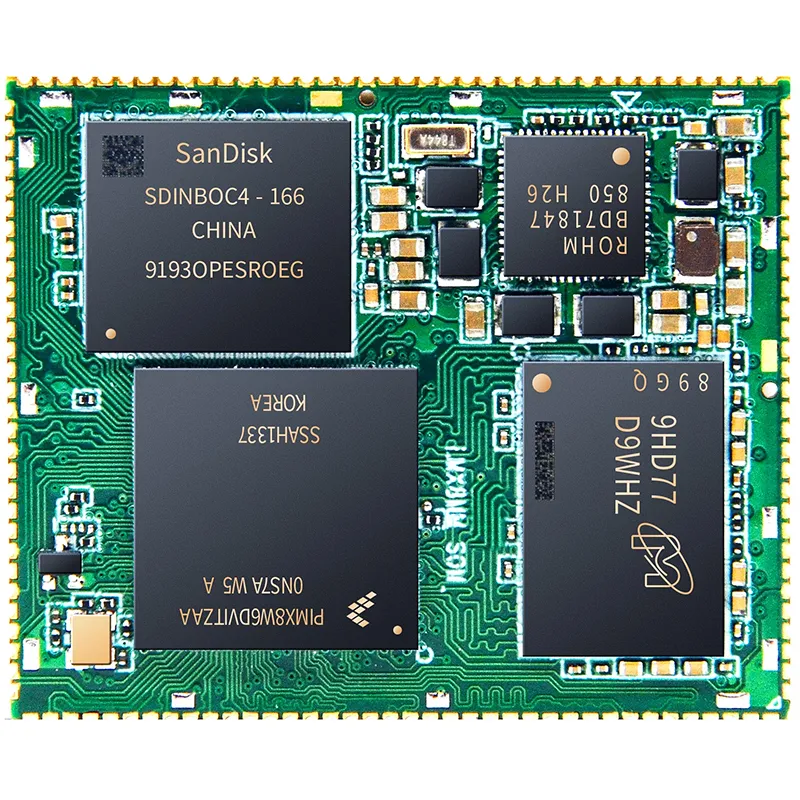

Платформенные модули NP серии Европа-Америка NP8MM, NP8MP, NP93, NS135

Платформенные модули NP серии Европа-Америка NP8MM, NP8MP, NP93, NS135 -

Блок диагностики OBD для автомобилей

Блок диагностики OBD для автомобилей -

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Интегрированная машина с большой моделью для интеллектуального захвата голоса -

Пульт дистанционного управления для БПЛА

Пульт дистанционного управления для БПЛА -

Цифровой домашний шлюз с национальной криптографией

Цифровой домашний шлюз с национальной криптографией -

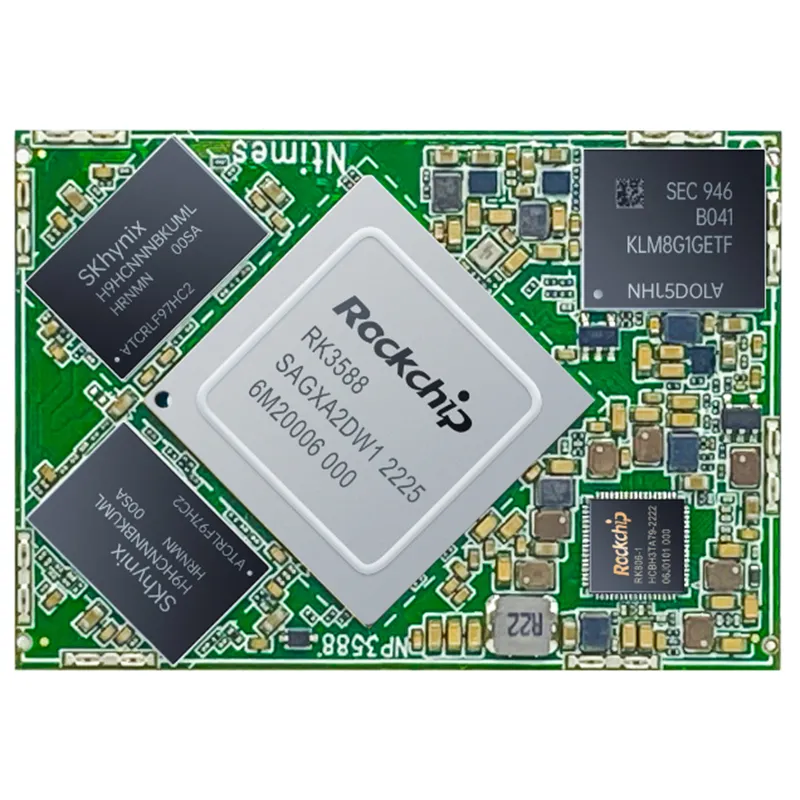

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588

Платформенные модули NP серии RK NPPX30,NP3566,NP3568,NP3576,NP3588S,NP3588

Связанный поиск

Связанный поиск- Промышленный наголовный дисплей AR

- Наголовный дисплей с коррекцией астигматизма

- Устройство периферийного восприятия

- Ручной анализатор сети доступа

- Бокс вычислений для 32 камер

- Промышленные БПЛА

- Основная материнская плата для воплощенных роботов

- Кастомизация промышленного планшета

- оборудование для обнаружения бпла

- промышленное портативное устройство для сбора данных