Встраиваемое устройство периферийных вычислений

Когда слышишь ?встраиваемое устройство периферийных вычислений?, первое, что приходит в голову многим — это какой-то мини-компьютер на базе Raspberry Pi или Jetson, воткнутый в станок или камеру. Но на практике всё сложнее и интереснее. Частая ошибка — считать, что главное здесь вычислительная мощность чипа. На деле же, ключевое — это надёжность работы в конкретных условиях, тепловыделение, энергопотребление и, что критично, готовность ПО и драйверов под задачу. Много проектов спотыкается именно на этом. Помню, как мы в начале пробовали взять, казалось бы, мощный модуль для системы технического зрения на производстве, а он в условиях вибрации и пыли начинал ?глючить? из-за неидеального контакта на разъёмах. Вот тогда и понимаешь, что периферийное устройство — это не компонент, а система.

От концепции к ?железу?: где кроются подводные камни

Итак, допустим, задача — создать интеллектуальную камеру для контроля качества на конвейере. Казалось бы, бери готовый модуль с ИИ-ускорителем, камеру, корпус — и продукт готов. Но нет. Первый камень — выбор платформы. Тот же NVIDIA Jetson — отличная штука для прототипов, но для серии нужно считать каждую копейку, да и тепловой режим в герметичном корпусе под цеховым освещением — это отдельная головная боль. Приходится идти на компромиссы: иногда лучше чуть менее мощный, но более холодный и стабильный чип.

Второй момент — интерфейсы. Нужна ли здесь гигабитная сеть или хватит Fast Ethernet? Будет ли устройство работать автономно или постоянно стримить данные на сервер? Подключение промышленных датчиков через GPIO или специальные шины? Каждый лишний разъём — это стоимость, место на плате и потенциальная точка отказа. В одном из проектов для беспилотных тележек мы переделывали плату трижды, потому что заказчик то добавлял, то убирал требование по CAN-шине для связи с двигателями.

И третий, самый неочевидный подводный камень — питание. В промышленности 24В — стандарт, но бывают скачки и помехи. Простая схема стабилизатора может не вывезти. Пришлось на одном из устройств для ?умного? ЖКХ ставить целую схему защиты, которая съедала драгоценные миллиамперы из бюджета энергопотребления. Вот тут и понимаешь, что проектирование встраиваемого устройства периферийных вычислений — это постоянный поиск баланса между ?хотелками? и суровой реальностью физических законов.

Программная часть: ад, который скрыт от глаз

Если с ?железом? более-менее понятно, то с софтом начинается магия, а чаще — головная боль. Современные устройства периферийных вычислений редко работают на голой ОС. Нужен контейнер с моделью машинного обучения, runtime для её выполнения, драйверы для камеры конкретной модели, сервис для обновления ?по воздуху? и мониторинга. И всё это должно запускаться быстро и работать месяцами без перезагрузки.

Ошибка, которую мы допустили в раннем проекте для медицинского сканера — собрали образ на базе Ubuntu с кучей библиотек. Всё работало на стенде. А на реальном устройстве при обновлении пакетов сломался драйвер GPU. Устройство ?в поле? превратилось в кирпич. Пришлось экстренно переходить на сборку Yocto, где всё жёстко контролируется, но и времени это отняло в разы больше. Теперь для каждого продукта мы сразу закладываем время на создание и поддержку собственного дистрибутива ОС — это дорого, но необходимо для надёжности.

Ещё одна боль — управление парком устройств. Когда у тебя одна опытная камера — её можно настроить по SSH. Когда их сто на разных заводах — нужна платформа удалённого управления. Мы для своих решений часто используем облачный сервис, но некоторые заказчики из госсектора или ВПК требуют полностью автономной работы в локальной сети. Приходится разворачивать локальный сервер обновлений и мониторинга, что опять усложняет и удорожает конечный продукт.

Кейсы из практики: успехи и провалы

Расскажу про один из удачных, но сложных проектов. Заказчик — производитель лифтов. Нужна была система предсказательного обслуживания, которая по вибрации и звуку двигателя могла бы определить износ подшипников. Встраиваемое устройство должно было встать в шахту лифта, работать от -30 до +50, с минимальным энергопотреблением (питание брали от самой системы лифта) и передавать данные раз в сутки по сотовой сети.

Железо собрали на базе маломощного процессора с DSP-блоком для обработки сигналов. Основная сложность была в алгоритме: как выделить полезный сигнал из общего шума. Месяца ушло только на сбор данных с разных лифтов для обучения модели. В итоге сделали. Устройство работает, заказчик доволен. Но рентабельность проекта под вопросом — слишком много кастомной разработки под очень узкую задачу.

А был и провал. Пытались сделать универсальный контроллер для ?умных? теплиц. Задумка — один блок управляет светом, поливом, вентиляцией и анализирует изображения с камер для выявления болезней растений. Сделали прототип на мощном процессоре. Но когда посчитали стоимость для массового производства, оказалось, что фермерам дешевле купить три отдельных простых контроллера, чем один наш ?умный?. Проект заморозили. Вывод: технологическая крутость не всегда равна коммерческому успеху. Иногда для периферийных вычислений важнее не мощность, а цена и простота интеграции.

Рынок и ниши: где сегодня есть смысл работать

Сейчас вижу несколько перспективных направлений. Первое — это, конечно, промышленность 4.0. Контроль качества, предсказательное обслуживание, управление роботами. Здесь важна надёжность и долгий цикл поддержки. Второе — медицинское оборудование. Не телемедицина, а именно встроенная аналитика в аппараты УЗИ, томографы, анализаторы. Требования жёсткие: сертификация, безопасность, безотказность.

Третье направление — автономные транспортные средства и роботы. Не обязательно полноценный беспилотный автомобиль. Это могут быть складские тележки, уборочные роботы, дроны для осмотра объектов. Здесь вызов — в обработке данных с множества датчиков в реальном времени и в работе в неструктурированной среде. Компании, которые умеют делать стабильное ?железо? для таких задач, будут востребованы.

Кстати, наблюдаю интересную тенденцию. Раньше все стремились делать свои устройства ?самыми умными?, засовывая туда огромные нейросетевые модели. Сейчас тренд на оптимизацию. Как сделать так, чтобы маленькая и дешёвая модель решала 95% задач, а сложные кейсы отправляла в облако? Это архитектурный вызов. Именно в таких задачах и проявляется мастерство проектировщика встраиваемых устройств периферийных вычислений.

Взгляд на игроков и кооперацию

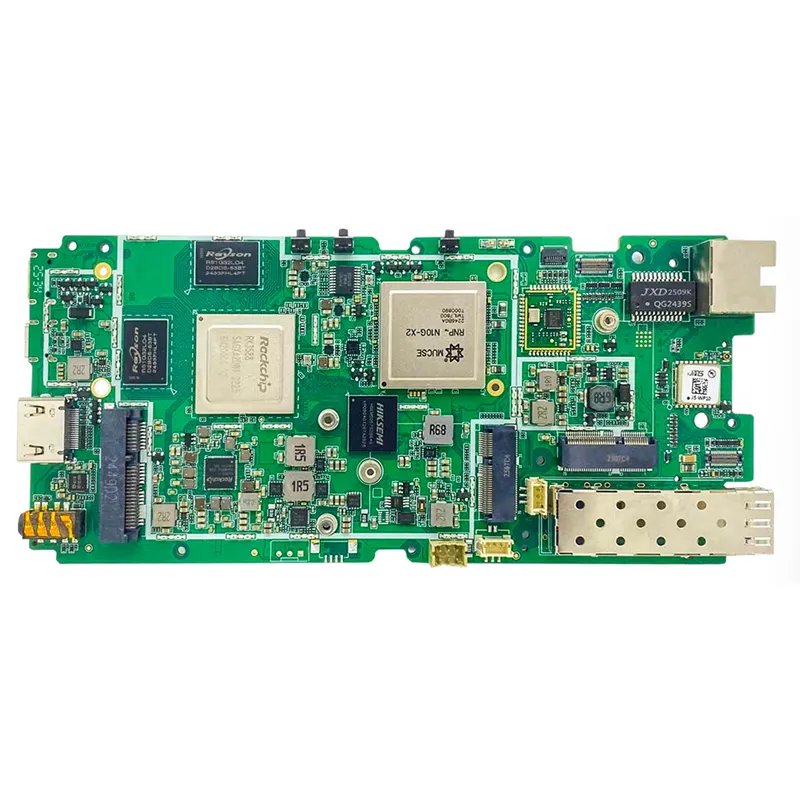

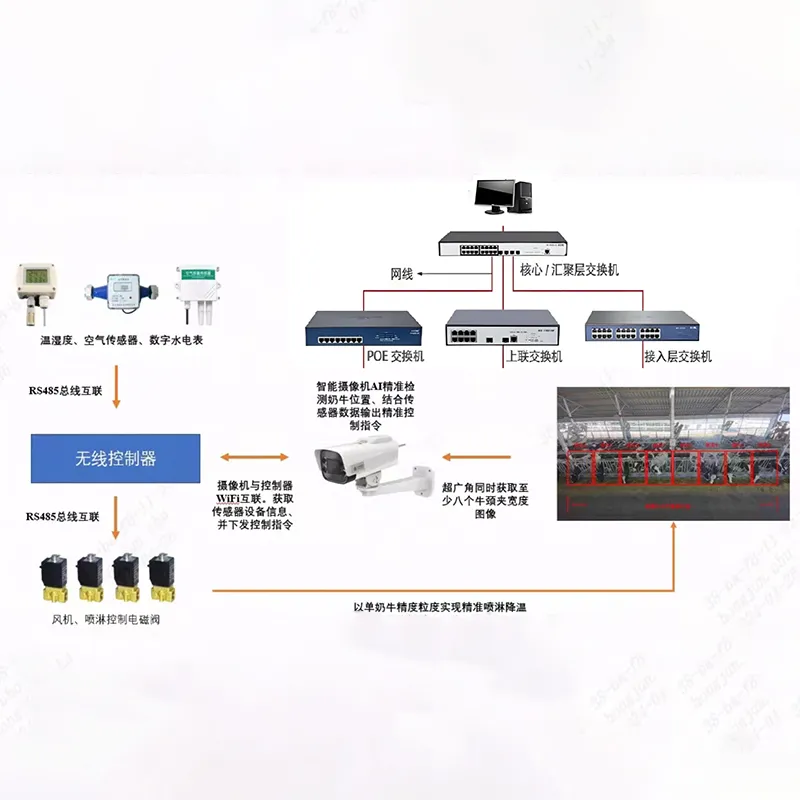

На рынке сейчас много кто: и гиганты вроде NVIDIA с их Jetson, и китайские производители модулей на Rockchip, Qualcomm, и множество мелких инженерных бюро. Выбор партнёра — это всегда риск. Мы, например, в некоторых проектах сотрудничаем с проектной компанией ООО Шэньчжэнь Энтаймс Технолоджи. Они не просто продают ?железо?, а профессионально занимаются развёртыванием вычислительного аппаратного обеспечения в готовые продукты для периферийного интеллекта. Это важно.

Их подход, судя по информации с сайта https://www.nnntimes.ru, близок к нашему: они фокусируются на конкретных областях вроде промышленности, автомобильной техники, роботов, медицинского оборудования. То есть понимают контекст. Когда партнёр делает не просто модуль, а помогает с дизайном отраслевого продукта, включая тепловые расчёты и выбор интерфейсов — это ценно. Их основная деятельность — модули и контроллеры интеллектуальных вычислений, а также полный цикл проектирования и производства. В нашем деле готовое решение ?под ключ? часто выигрывает у набора комплектующих.

Но кооперация — это палка о двух концах. Передавая часть разработки на сторону, ты теряешь контроль и часть маржи. Зато получаешь доступ к экспертизе и ускоряешь время выхода на рынок. Для стартапов или компаний, которые хотят быстро зайти в новую нишу (скажем, с медицинскими приборами), такой путь через проектные компании, подобные Энтаймс Технолоджи, может быть оптимальным. Главное — чётко прописать в договоре все требования по надёжности, документации и долгосрочной доступности компонентов.

Итоговые мысли не в заключение

Так к чему же всё это? Встраиваемое устройство периферийных вычислений — это не про тренды и не про то, чтобы впихнуть в коробку самый современный чип. Это про решение конкретной проблемы в реальных условиях. Про баланс. Про понимание того, что будет с устройством через три года работы в цеху, в лифтовой шахте или в кабине беспилотной тележки.

Самый важный навык здесь — не умение читать даташиты (хотя и это нужно), а способность задавать заказчику правильные вопросы. ?А что, если сеть пропадёт на сутки??, ?А кто будет менять устройство, когда оно сломается??, ?А как вы будете обновлять модель ИИ??. Ответы на эти вопросы определяют архитектуру больше, чем любые технические спецификации.

Поэтому, если кто-то думает войти в эту область в поисках быстрых денег — это не сюда. Здесь деньги медленные, проекты долгие, а риски высокие. Но зато, когда твоё устройство, в котором ты копался месяцами, годами работает где-то там, решая реальную задачу — это та самая профессиональная satisfaction, ради которой многие из нас и занимаются этой сложной, но безумно интересной работой по созданию интеллекта на самом краю сети.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

Медицинский монитор

Медицинский монитор -

Пульт дистанционного управления для БПЛА

Пульт дистанционного управления для БПЛА -

Наголовный 4K гигантский экран 3D плеер

Наголовный 4K гигантский экран 3D плеер -

Интеллектуальная платформа 80T/128T

Интеллектуальная платформа 80T/128T -

Подвесная капсула для БПЛА

Подвесная капсула для БПЛА -

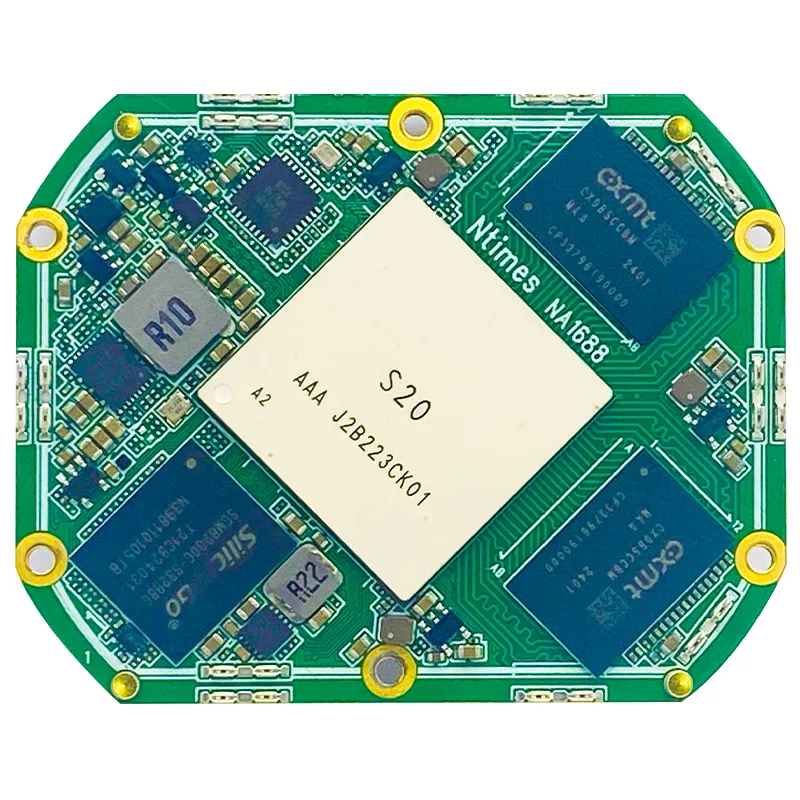

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P

Интеллектуальный вычислительный модуль серия NA NA1126BP,NA186,NA1688,NA6E,NA6P -

Интегрированная машина с большой моделью для интеллектуального захвата голоса

Интегрированная машина с большой моделью для интеллектуального захвата голоса -

Интегрированная машина с большой моделью для умных фонарных столбов

Интегрированная машина с большой моделью для умных фонарных столбов -

Вычислительные боксы Z4,Z6E,Z6P 32T,80T,128T

Вычислительные боксы Z4,Z6E,Z6P 32T,80T,128T -

Блок диагностики OBD для автомобилей

Блок диагностики OBD для автомобилей -

Мобильный наголовный 3D дисплей

Мобильный наголовный 3D дисплей -

Наземная станция для БПЛА AheadX

Наземная станция для БПЛА AheadX

Связанный поиск

Связанный поиск- Бокс периферийных вычислений

- Интеллектуальный агент с круговым обзором 360°

- промышленное портативное устройство для сбора данных

- Интеллектуальный модуль безопасности SOM

- Бокс периферийных вычислений с 5G

- Встраиваемый вычислительный бокс

- 4K наголовный дисплей

- Ручной анализатор волоконно-оптических сетей 10G

- 128Т материнская плата для роботов

- NXP SOM